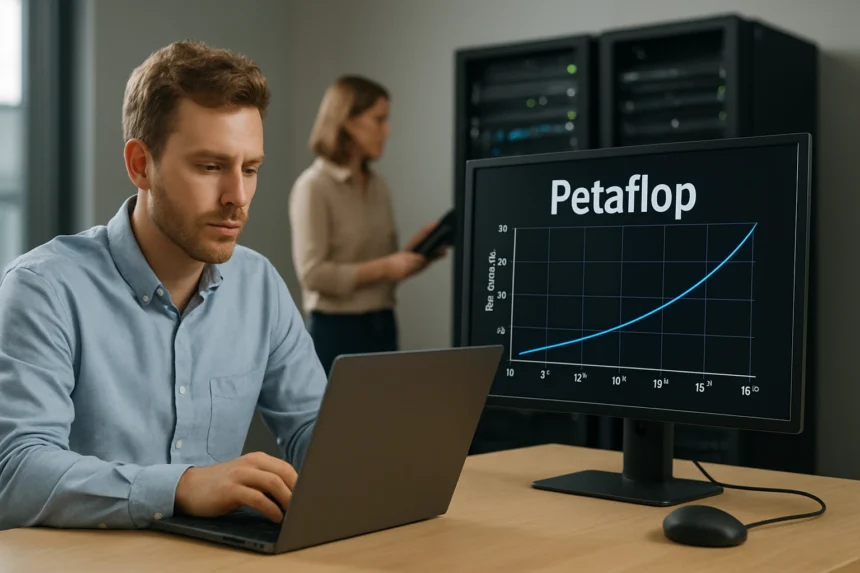

A modern technológiai világban élve nap mint nap hallunk a számítógépek egyre növekvő teljesítményéről, mégis kevesen értjük pontosan, mit jelentenek ezek a hatalmas számok. A petaflop fogalma különösen izgalmas területe a számítástechnikának, mivel olyan teljesítményszinteket jelöl, amelyek korábban elképzelhetetlenek voltak.

A petaflop egy rendkívül nagy számítási teljesítménymértékegység, amely másodpercenként ezer billió lebegőpontos műveletet jelent. Ez a mérték elsősorban a szuperszámítógépek világában játszik központi szerepet, ahol a tudományos kutatások, időjárás-előrejelzés és komplex szimulációk igénylik a maximális számítási kapacitást.

Az elkövetkező sorokban részletesen megismerheted a petaflop pontos definícióját, a számítási sebesség mérésének különböző módszereit, és azt, hogyan viszonyul ez a mindennapi számítógépek teljesítményéhez. Betekintést nyersz a szuperszámítógépek világába, megérted a különböző teljesítménymérési standardokat, és praktikus példákon keresztül láthatod, mit jelentenek ezek a számok a valóságban.

A petaflop pontos definíciója és jelentősége

A petaflop (PFLOPS – Peta Floating Point Operations Per Second) a számítási teljesítmény mérésének egyik legnagyobb egysége. Egy petaflop pontosan 10^15, azaz 1 000 000 000 000 000 lebegőpontos műveletet jelent másodpercenként.

A lebegőpontos műveletek alapvetően olyan matematikai számításokat jelentenek, amelyekben tizedes számokkal dolgozunk. Ezek lehetnek összeadások, kivonások, szorzások vagy osztások, amelyek mind jelentős számítási kapacitást igényelnek.

A petaflop kategóriába tartozó gépek képesek olyan komplex feladatok megoldására, mint a molekuláris szimulációk, nukleáris reakciók modellezése, vagy akár teljes galaxisok mozgásának előrejelzése. Ezek a számítások hagyományos számítógépeken évtizedekig vagy évszázadokig tartanának.

A számítási sebesség mérésének alapjai

A számítási teljesitőképesség mérése több különböző módszerrel történhet:

- FLOPS (Floating Point Operations Per Second) – lebegőpontos műveletek száma másodpercenként

- MIPS (Million Instructions Per Second) – millió utasítás másodpercenként

- IPS (Instructions Per Second) – utasítások száma másodpercenként

- Whetstone és Dhrystone benchmarkok – standardizált teljesítménytesztek

- SPEC benchmarkok – ipari szabványú teljesítménymérési eszközök

A FLOPS mérték azért vált különösen fontossá, mert a tudományos számításokban a lebegőpontos műveletek dominálnak. Ezek pontossága és sebessége kritikus jelentőségű a kutatási eredmények megbízhatósága szempontjából.

A teljesítménymérési skála hierarchiája

| Mértékegység | Rövidítés | Műveletek/másodperc | Példa felhasználás |

|---|---|---|---|

| Kiloflop | KFLOPS | 10³ | Egyszerű kalkulátorok |

| Megaflop | MFLOPS | 10⁶ | Személyi számítógépek (1980-as évek) |

| Gigaflop | GFLOPS | 10⁹ | Modern asztali számítógépek |

| Teraflop | TFLOPS | 10¹² | Gaming számítógépek, kisebb szerverek |

| Petaflop | PFLOPS | 10¹⁵ | Szuperszámítógépek |

| Exaflop | EFLOPS | 10¹⁸ | Jövőbeli szuperszámítógépek |

A skála exponenciális növekedést mutat, ahol minden lépcsőfok ezres szorzót jelent az előzőhöz képest. Ez jól szemlélteti a technológiai fejlődés ütemét és a számítási igények robbanásszerű növekedését.

A modern grafikus kártyák (GPU-k) már teraflop tartományban mozognak, míg a legújabb gaming processzorok több száz gigaflop teljesítményre képesek. A szuperszámítógépek azonban már a petaflop és exaflop tartományban versenyeznek.

Szuperszámítógépek és a TOP500 lista

A TOP500 lista a világ leggyorsabb szuperszámítógépeinek rangsorolása, amelyet félévente frissítenek. Ez a lista a LINPACK benchmark alapján méri a gépek teljesítményét, amely kifejezetten a lebegőpontos műveletek sebességét teszteli.

Az első petaflop teljesítményű szuperszámítógép az IBM Roadrunner volt 2008-ban, amely 1,026 petaflop csúcsteljesítményt ért el. Ez óriási mérföldkő volt a számítástechnika történetében, mivel korábban elképzelhetetlen számítási kapacitást jelentett.

Napjainkban a vezető szuperszámítógépek már több száz petaflop teljesítményre képesek. A Frontier szuperszámítógép például 2022-ben átlépte az exaflop határt, ezzel új korszakot nyitva a nagy teljesítményű számítástechnikában.

A petaflop teljesítmény gyakorlati alkalmazásai

A petaflop szintű számítási kapacitás lehetővé teszi olyan kutatási területek fejlődését, amelyek korábban elérhetetlen számítási igényekkel rendelkeztek:

- Klimatológiai modellek: A globális éghajlatváltozás pontos előrejelzése

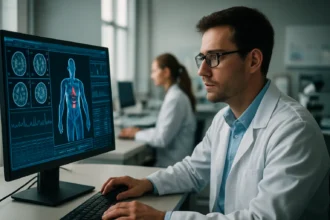

- Gyógyszerkutatás: Molekuláris szintű gyógyszerhatás-vizsgálatok

- Asztrofizika: Galaxisok ütközésének szimulációja

- Nukleáris fizika: Atomreaktorok biztonsági elemzései

- Mesterséges intelligencia: Nagy neurális hálózatok betanítása

"A petaflop teljesítmény olyan számítási kapacitást jelent, amely lehetővé teszi a valóság legkomplexebb jelenségeinek modellezését és megértését."

Benchmarking és teljesítménymérési módszerek

A számítási teljesítmény mérése összetett feladat, mivel különböző típusú számításokhoz eltérő optimalizálási stratégiák szükségesek. A legfontosabb benchmarking módszerek közé tartoznak:

A LINPACK benchmark lineáris egyenletrendszerek megoldásának sebességét méri. Ez a teszt különösen alkalmas a szuperszámítógépek összehasonlítására, mivel jól skálázódik nagy processzorhálózatokon.

A High Performance Computing Challenge (HPCC) benchmark sokrétűbb tesztkészlet, amely különböző típusú számítási feladatokat tartalmaz. Ez reálisabb képet ad a gépek valós teljesítményéről.

A Graph500 benchmark a nagy adathalmazok elemzésére specializálódott, amely egyre fontosabbá válik a big data korszakában. Ez a teszt nem a lebegőpontos műveletek sebességét, hanem az adatkezelési képességeket értékeli.

Hardverarchitektúrák és optimalizálás

A petaflop teljesítmény elérése speciális hardverarchitektúrákat igényel. A modern szuperszámítógépek általában hibrid architektúrát használnak, amely hagyományos CPU-kat és specializált gyorsítókat kombinál.

A GPU-gyorsítás forradalmasította a nagy teljesítményű számítástechnikát. A grafikus processzorok párhuzamos architektúrája ideális a tudományos számításokhoz szükséges műveletek elvégzésére.

Az FPGA (Field-Programmable Gate Array) technológia szintén fontos szerepet játszik, különösen olyan alkalmazásokban, ahol specifikus számítási mintázatok optimalizálására van szükség.

"A petaflop teljesítmény nem csak a nyers számítási sebesség kérdése, hanem a hardver és szoftver tökéletes összehangolásának eredménye."

Energiahatékonyság és fenntarthatóság

A petaflop teljesítményű rendszerek óriási energiafogyasztással járnak. A Green500 lista éppen ezért az energiahatékonyság alapján rangsorolja a szuperszámítógépeket, megaflop/watt mértékegységben mérve.

A modern szuperszámítógépek több megawatt energiát fogyasztanak, ami egy kisebb város energiaigényének felel meg. Ez komoly kihívást jelent a fenntartható számítástechnika területén.

A liquid cooling technológiák és a kvantum-számítástechnika ígéretes irányok az energiahatékonyság javítása érdekében. Ezek a technológiák lehetővé tehetik a jövőben még nagyobb teljesítmény elérését alacsonyabb energiafogyasztás mellett.

| Szuperszámítógép | Teljesítmény (PFLOPS) | Energiafogyasztás (MW) | Hatékonyság (GFLOPS/W) |

|---|---|---|---|

| Frontier | 1194 | 21.1 | 56.6 |

| Aurora | 1059 | 38.7 | 27.4 |

| Eagle | 561 | 28.5 | 19.7 |

| Fugaku | 442 | 28.3 | 15.6 |

Jövőbeli trendek és fejlesztések

Az exaflop korszak megnyitása után a kutatók már a zettaflop (10^21 műveletek/másodperc) teljesítmény elérésén dolgoznak. Ez olyan számítási kapacitást jelentene, amely lehetővé tenné az emberi agy teljes szimulációját.

A kvantum-számítástechnika párhuzamos fejlődése új paradigmát hozhat a nagy teljesítményű számítástechnikába. Bár a kvantumszámítógépek más típusú feladatokra optimalizáltak, hibrid rendszerekben kombinálva hagyományos szuperszámítógépekkel forradalmi eredményeket érhetünk el.

A neuromorphic computing és a photonic computing szintén ígéretes technológiák, amelyek új megközelítést kínálnak a nagy teljesítményű számítástechnika területén.

"A petaflop teljesítmény csak a kezdet – a jövő exaflop és zettaflop rendszerei teljesen új tudományos felfedezéseket tesznek majd lehetővé."

Alkalmazási területek részletesen

Tudományos kutatás és szimuláció

A petaflop teljesítményű rendszerek lehetővé teszik olyan tudományos szimulációk futtatását, amelyek korábban megvalósíthatatlanok voltak. A molekuláris dinamika szimulációk például képesek több millió atom viselkedésének követésére hosszú időtartamon keresztül.

A kozmológiai szimulációk segítségével a tudósok az univerzum kialakulását és fejlődését modellezhetik a Nagy Bumm után néhány millió évtől napjainkig. Ezek a számítások óriási mennyiségű adatot generálnak és rendkívül komplex matematikai modelleket igényelnek.

A folyadékdinamikai szimulációk területén a petaflop teljesítmény lehetővé teszi turbulens áramlások pontos modellezését, ami kritikus fontosságú a repülőgép-tervezésben és az időjárás-előrejelzésben.

Mesterséges intelligencia és gépi tanulás

A modern AI rendszerek betanítása hatalmas számítási kapacitást igényel. A nagy nyelvi modellek (LLM-ek) mint a GPT sorozat tagjai, petaflop-nap mértékű számítási időt igényelnek a betanításhoz.

A deep learning algoritmusok optimalizálása során milliárd paraméter finomhangolására van szükség, ami csak petaflop szintű teljesítménnyel végezhető el ésszerű időkereten belül. A neurális hálózatok architektúrájának fejlesztése szintén intenzív számítási erőforrásokat igényel.

A számítógépes látás és természetes nyelvfeldolgozás területén a petaflop teljesítmény lehetővé teszi valós idejű, komplex feladatok megoldását nagy pontossággal.

"A mesterséges intelligencia fejlődése szorosan összefügg a rendelkezésre álló számítási kapacitással – a petaflop teljesítmény új AI képességeket nyit meg."

Költségek és gazdasági szempontok

A petaflop teljesítményű szuperszámítógépek építése és üzemeltetése rendkívül költséges vállalkozás. Egy ilyen rendszer költsége általában több száz millió dollár, az üzemeltetési költségek pedig évente több tízmillió dollárt is elérhetnek.

A beruházási költségek magukban foglalják a hardvert, az infrastruktúrát, a hűtési rendszereket és a speciális szoftvereket. Az üzemeltetési költségek elsősorban az energiafogyasztásból, a karbantartásból és a szakképzett személyzet fizetéséből állnak.

A megtérülés azonban jelentős lehet, különösen olyan területeken, mint a gyógyszerkutatás, ahol egy új gyógyszer fejlesztése milliárd dolláros befektetést igényel. A szimulációk segítségével jelentősen csökkenthető a kísérleti költségek és a fejlesztési idő.

Hozzáférhetőség és cloud computing

A petaflop teljesítmény egyre inkább elérhető cloud szolgáltatások formájában is. Az Amazon Web Services, Microsoft Azure és Google Cloud Platform mind kínálnak nagy teljesítményű számítási szolgáltatásokat.

Ez demokratizálja a hozzáférést a szuperszámítógépes kapacitásokhoz, lehetővé téve kisebb kutatócsoportok és vállalkozások számára is, hogy kihasználják ezeket a lehetőségeket. A pay-per-use modell különösen vonzó olyan projektek számára, amelyek csak időszakosan igényelnek nagy számítási kapacitást.

A hibrid cloud megoldások kombinálják a helyi infrastruktúra előnyeit a cloud rugalmasságával, optimalizálva a költségeket és a teljesítményt.

Biztonsági és megbízhatósági kérdések

A petaflop teljesítményű rendszerek kritikus infrastruktúrának számítanak, ezért különös figyelmet kell fordítani a kiberbiztonsági kérdésekre. Ezek a rendszerek gyakran nemzetbiztonsági szempontból is érzékeny kutatásokat végeznek.

A redundancia és hibatűrés alapvető követelmények. A több ezer processzorból álló rendszerekben statisztikailag elkerülhetetlen, hogy egyes komponensek meghibásodnak. A rendszereknek képesnek kell lenniük a hibás komponensek automatikus kikapcsolására és a számítások folytatására.

A checkpoint mechanizmusok lehetővé teszik a hosszú futásidejű számítások mentését és újraindítását hiba esetén. Ez kritikus fontosságú olyan szimulációknál, amelyek hetekig vagy hónapokig futnak.

"A petaflop rendszerek megbízhatósága nem csak technikai kérdés, hanem a tudományos kutatás kontinuitásának alapja."

Programozási kihívások és szoftveroptimalizálás

A petaflop teljesítmény kihasználása speciális programozási technikákat igényel. A párhuzamos programozás nem csupán lehetőség, hanem alapvető követelmény ezeken a rendszereken.

A MPI (Message Passing Interface) és OpenMP szabványok biztosítják a párhuzamos futás alapjait, de a hatékony kihasználás komplex algoritmusok tervezését igényli. A load balancing kritikus fontosságú a teljesítmény optimalizálása érdekében.

A heterogén architektúrák programozása még nagyobb kihívást jelent, mivel különböző típusú processzorok (CPU, GPU, FPGA) optimális kihasználását kell megoldani egyetlen alkalmazáson belül.

Szoftvereszközök és fejlesztőkörnyezetek

A petaflop rendszereken való fejlesztés speciális eszközöket igényel:

- Profiling eszközök: A teljesítmény szűk keresztmetszeteinek azonosítása

- Debugging eszközök: Párhuzamos alkalmazások hibakeresése

- Optimalizáló compilerek: A kód automatikus optimalizálása

- Workflow management rendszerek: Komplex számítási folyamatok vezérlése

- Monitoring eszközök: Rendszerteljesítmény valós idejű követése

A DevOps gyakorlatok alkalmazása a szuperszámítógépes környezetben segít a fejlesztési ciklusok gyorsításában és a kód minőségének javításában.

Oktatás és szakemberképzés

A petaflop technológiák kezelése speciális szakértelmet igényel. Az egyetemek nagy teljesítményű számítástechnika szakirányokat indítanak, hogy képezzék a szükséges szakembereket.

A hands-on képzés különösen fontos, mivel a elméleti tudás mellett gyakorlati tapasztalat is szükséges. Sok egyetem campus cluster programokat indított, amelyek lehetővé teszik a hallgatók számára a szuperszámítógépes technológiák megismerését.

A nemzetközi együttműködés és student exchange programok segítenek a tudás megosztásában és a legjobb gyakorlatok terjesztésében.

"A petaflop korszak sikere nem csak a technológián múlik, hanem azon, hogy képzett szakemberek álljanak rendelkezésre a lehetőségek kihasználásához."

Nemzetközi verseny és geopolitikai aspektusok

A petaflop teljesítményű szuperszámítógépek birtoklása nemzeti presztízs és stratégiai előny kérdése. Az Egyesült Államok, Kína, Japán és az Európai Unió között intenzív verseny folyik a vezető pozícióért.

A technológiai szuverenitás szempontjából kritikus fontosságú a saját szuperszámítógépes kapacitások fejlesztése. Ez nemcsak a kutatási függetlenséget biztosítja, hanem nemzetbiztonsági szempontból is kulcsfontosságú.

Az export control szabályozások korlátozhatják bizonyos technológiák nemzetközi kereskedelmét, ami befolyásolja a globális szuperszámítógépes ökoszisztéma fejlődését.

Milyen különbség van a petaflop és a teraflop között?

A petaflop ezerszer nagyobb teljesítményt jelent, mint a teraflop. Míg egy teraflop másodpercenként ezer milliárd műveletet jelent, addig a petaflop másodpercenként ezer billió műveletet. Ez hatalmas különbség a gyakorlati alkalmazások szempontjából.

Mennyi ideig tart egy petaflop teljesítményű számítás?

Ez teljesen függ a feladat komplexitásától. Egy petaflop teljesítményű rendszer képes másodpercenként ezer billió műveletet elvégezni, de egy komplex tudományos szimuláció még így is órákig, napokig vagy akár hetekig futhat.

Miért fontos a lebegőpontos műveletek mérése?

A lebegőpontos műveletek a tudományos számításokban a leggyakoribbak, mivel pontos tizedes számokkal való számolást igényelnek. Ezért a FLOPS mérték jobban tükrözi a szuperszámítógépek valós teljesítményét, mint más mérőszámok.

Lehet-e otthoni számítógéppel petaflop teljesítményt elérni?

Egyetlen otthoni számítógép nem képes petaflop teljesítményre. A leggyorsabb gaming PC-k is csak teraflop tartományban mozognak. Petaflop teljesítményhez több ezer speciális processzor összehangolt működése szükséges.

Hogyan viszonyul a petaflop teljesítmény a kvantumszámítógépekhez?

A kvantumszámítógépek más típusú számításokra optimalizáltak, és teljesítményüket nem FLOPS-ban mérik. Bizonyos specifikus problémák megoldásában a kvantumszámítógépek exponenciálisan gyorsabbak lehetnek, míg mások esetében a hagyományos szuperszámítógépek jobbak.

Mennyibe kerül egy petaflop teljesítményű szuperszámítógép?

A költségek széles skálán mozognak, de általában több száz millió dollárról van szó. Ez magában foglalja a hardvert, infrastruktúrát, telepítést és kezdeti üzembe helyezést. Az éves üzemeltetési költségek szintén több tízmillió dollárt tehetnek ki.