A modern digitális világ egyik legmeghatározóbb kihívása, hogy hogyan tudják a vállalatok lépést tartani a folyamatosan növekvő adatmennyiséggel és felhasználói igényekkel. A hagyományos IT-infrastruktúra gyakran nem képes rugalmasan alkalmazkodni ezekhez a változásokhoz, ami komoly üzleti kockázatokat rejt magában.

A hiperskálázható felhő egy olyan fejlett felhőalapú megoldás, amely lehetővé teszi a számítási erőforrások dinamikus és automatikus méretezését a valós idejű igények alapján. Ez a technológia forradalmasította azt, ahogyan a szervezetek kezelik az IT-infrastruktúrájukat. A témát több szemszögből is megvizsgáljuk: a technológiai alapoktól kezdve a gyakorlati alkalmazásokig.

Ebben az átfogó útmutatóban megismerkedhetsz a hiperskálázható felhő minden fontos aspektusával. Megtudhatod, hogyan működik a gyakorlatban, milyen előnyöket nyújt, és hogyan implementálhatod saját szervezetedben. Konkrét példákon keresztül mutatjuk be a legfontosabb szolgáltatókat és technológiákat.

A hiperskálázható felhő alapvető jellemzői

A hiperskálázhatóság fogalma az elastikus skálázás elvén alapul, amely szerint a rendszer automatikusan képes növelni vagy csökkenteni a rendelkezésre álló erőforrásokat. Ez a képesség különbözteti meg a hagyományos, statikus infrastruktúrától.

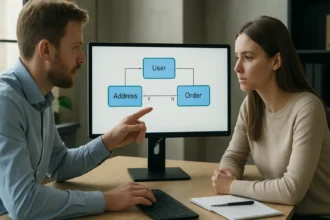

A technológia három fő pillérre épül: automatizáció, virtualizáció és elosztott architektúra. Az automatizáció biztosítja, hogy a rendszer emberi beavatkozás nélkül reagáljon a változásokra. A virtualizáció lehetővé teszi a fizikai erőforrások rugalmas elosztását, míg az elosztott architektúra garantálja a magas rendelkezésre állást.

A modern hiperskálázható rendszerek mikroszolgáltatás-alapú architektúrát használnak, amely kisebb, független komponensekre bontja az alkalmazásokat. Ez a megközelítés lehetővé teszi, hogy csak azok a részek skálázzanak, amelyekre valóban szükség van.

Technológiai alapok és működési elvek

A hiperskálázható felhő működése komplex algoritmusokon és előrejelző modelleken alapul. A gépi tanulás és mesterséges intelligencia segítségével a rendszer képes előre jelezni a terhelés változásait.

A konténerizáció technológiája, különösen a Docker és Kubernetes, központi szerepet játszik a hiperskálázhatóságban. Ezek a technológiák lehetővé teszik az alkalmazások gyors telepítését és skálázását több szerver között.

Az API-vezérelt infrastruktúra biztosítja, hogy minden erőforrás programozottan kezelhető legyen. Ez alapvető fontosságú a dinamikus skálázás megvalósításához.

Főbb szolgáltatók és platformok

A hiperskálázható felhő piacát néhány nagy szereplő uralja, akik különböző megközelítéseket alkalmaznak ugyanarra a problémára.

Amazon Web Services (AWS) az Auto Scaling Groups és Elastic Load Balancing szolgáltatásaival vezeti a piacot. Az AWS Lambda serverless platformja lehetővé teszi a kód futtatását infrastruktúra kezelése nélkül. A CloudWatch monitorozási szolgáltatás valós idejű metrikákat biztosít a skálázási döntésekhez.

Microsoft Azure a Virtual Machine Scale Sets és Azure App Service segítségével kínál hiperskálázható megoldásokat. Az Azure Functions serverless platform versenyez az AWS Lambda-val. A Azure Monitor átfogó megfigyelési képességeket nyújt.

Google Cloud Platform innovációi

A Google Cloud Platform (GCP) a Compute Engine Autoscaler és Google Kubernetes Engine révén biztosít hiperskálázhatóságot. A Cloud Functions serverless megoldása szintén népszerű választás a fejlesztők körében.

A GCP különlegessége a Preemptible VM instances használata, amely jelentős költségmegtakarítást eredményezhet. Ezek a virtuális gépek akár 80%-kal olcsóbbak lehetnek, cserébe a Google bármikor leállíthatja őket.

A BigQuery adattárház szolgáltatás automatikusan skálázódik a lekérdezések összetettségének megfelelően. Ez kiváló példa arra, hogyan lehet adatfeldolgozási feladatokat hiperskálázható módon megoldani.

Skálázási stratégiák és módszerek

A hiperskálázható felhőben két fő skálázási irány létezik: horizontális és vertikális skálázás. A horizontális skálázás során új szervereket adunk a rendszerhez, míg a vertikális skálázás esetén a meglévő szerverek kapacitását növeljük.

A reaktív skálázás a jelenlegi terhelés alapján hoz döntéseket, míg a prediktív skálázás előrejelzések alapján működik. A prediktív megközelítés általában hatékonyabb, mert megelőzi a teljesítményproblémákat.

A küszöbérték-alapú skálázás egyszerű metrikákon alapul, mint a CPU-használat vagy memóriafogyasztás. A mesterséges intelligencia-alapú skálázás összetettebb mintákat ismer fel és pontosabb előrejelzéseket készít.

Automatikus skálázási algoritmusok

A modern hiperskálázható rendszerek különböző algoritmusokat használnak az optimális erőforrás-allokációhoz. A threshold-based scaling a legegyszerűbb megközelítés, amely előre definiált küszöbértékek alapján működik.

A predictive scaling algoritmusok historikus adatok és gépi tanulás segítségével előre jelzik a terhelés változásait. Ez lehetővé teszi a proaktív skálázást, amely megelőzi a teljesítményproblémákat.

A reinforcement learning alapú algoritmusok folyamatosan tanulnak a rendszer viselkedéséből és optimalizálják a skálázási döntéseket. Ezek a legfejlettebb megoldások, amelyek idővel egyre pontosabbá válnak.

Költségoptimalizálás és erőforrás-kezelés

A hiperskálázható felhő egyik legnagyobb előnye a költséghatékonyság, de csak akkor, ha megfelelően konfiguráljuk. A rossz beállítások akár többszörös költségeket is okozhatnak.

A spot instances és reserved instances használata jelentős megtakarítást eredményezhet. A spot instances akár 90%-kal olcsóbbak lehetnek, de nem garantálják a folyamatos rendelkezésre állást. A reserved instances hosszú távú elköteleződést igényelnek, cserébe kedvezményes árazást kínálnak.

A rightsizing folyamata során optimalizáljuk az erőforrások méretét a tényleges igényeknek megfelelően. Gyakran előfordul, hogy a szervezetek túlméretezett példányokat használnak, ami felesleges költségeket okoz.

| Skálázási típus | Előnyök | Hátrányok | Ideális használat |

|---|---|---|---|

| Reaktív | Egyszerű implementáció | Késleltetett reakció | Stabil terhelés |

| Prediktív | Proaktív optimalizáció | Komplex beállítás | Ciklikus terhelés |

| Hibrid | Kiegyensúlyozott megközelítés | Magas komplexitás | Vegyes terhelés |

Monitorozás és teljesítménymérés

A hatékony hiperskálázás átfogó monitorozást igényel. A kulcs metrikák között szerepel a CPU-használat, memóriafogyasztás, hálózati forgalom és válaszidők.

A Application Performance Monitoring (APM) eszközök, mint a New Relic, Datadog vagy AppDynamics, részletes betekintést nyújtanak az alkalmazások teljesítményébe. Ezek az eszközök segítenek azonosítani a szűk keresztmetszeteket és optimalizálási lehetőségeket.

A log aggregation és distributed tracing technológiák lehetővé teszik a komplex, elosztott rendszerek hibakeresését és teljesítményoptimalizálását.

Biztonsági megfontolások

A hiperskálázható felhő környezetben a biztonság különös figyelmet igényel, mivel a dinamikusan változó infrastruktúra új kihívásokat teremt.

Az Identity and Access Management (IAM) rendszerek biztosítják, hogy csak a megfelelő jogosultságokkal rendelkező entitások férhessenek hozzá az erőforrásokhoz. A szerepalapú hozzáférés-vezérlés (RBAC) segít minimalizálni a biztonsági kockázatokat.

A network security groups és firewalls dinamikus konfigurációja elengedhetetlen a változó infrastruktúra védelmében. Az encryption in transit és encryption at rest biztosítja az adatok védelmét.

"A hiperskálázható felhő nem csak technológiai újítás, hanem paradigmaváltás, amely újradefiniálja a modern IT-infrastruktúra fogalmát."

Zero Trust architektúra

A Zero Trust biztonsági modell különösen fontos a hiperskálázható környezetekben. Ez a megközelítés azt feltételezi, hogy semmiben sem bízhatunk meg alapértelmezetten, minden hozzáférést ellenőrizni kell.

A micro-segmentation technika kis hálózati szegmensekre osztja a rendszert, korlátozva a potenciális támadások terjedését. A continuous authentication biztosítja, hogy a felhasználók és szolgáltatások identitása folyamatosan ellenőrizve legyen.

A security automation eszközök segítenek gyorsan reagálni a biztonsági incidensekre és automatizálni a védekezési mechanizmusokat.

Gyakorlati implementációs lépések

A hiperskálázható felhő bevezetése strukturált megközelítést igényel. Az első lépés a jelenlegi infrastruktúra és alkalmazások felmérése.

Az alkalmazások refaktorálása gyakran szükséges a hiperskálázhatóság eléréséhez. A monolitikus alkalmazásokat mikroszolgáltatásokra kell bontani, és cloud-native technológiákat kell alkalmazni.

A CI/CD pipeline kialakítása elengedhetetlen a gyors és megbízható telepítésekhez. Az Infrastructure as Code (IaC) eszközök, mint a Terraform vagy CloudFormation, lehetővé teszik az infrastruktúra verziókövetését és automatizálását.

Migrációs stratégiák

A lift and shift megközelítés a legegyszerűbb migrációs stratégia, ahol a meglévő alkalmazásokat változtatás nélkül költöztetjük a felhőbe. Ez gyors eredményeket ad, de nem használja ki teljes mértékben a hiperskálázhatóság előnyeit.

A re-platforming során kisebb módosításokat végzünk az alkalmazásokon, hogy jobban kihasználják a felhő képességeit. A refactoring a legátfogóbb megközelítés, amely során teljesen újratervezzük az alkalmazásokat.

A strangler fig pattern lehetővé teszi a fokozatos migrációt, ahol az új rendszer fokozatosan váltja fel a régit anélkül, hogy megszakítaná a szolgáltatást.

| Migráció típusa | Időtartam | Komplexitás | Hiperskálázhatóság |

|---|---|---|---|

| Lift and Shift | 1-3 hónap | Alacsony | Korlátozott |

| Re-platforming | 3-6 hónap | Közepes | Jó |

| Refactoring | 6-18 hónap | Magas | Kiváló |

Teljesítményoptimalizálás és finomhangolás

A hiperskálázható rendszerek folyamatos optimalizálást igényelnek a maximális hatékonyság eléréséhez. A teljesítménymérés és finomhangolás iteratív folyamat.

A load testing és stress testing segít meghatározni a rendszer határait és optimalizálási pontjait. Az A/B testing lehetővé teszi különböző konfigurációk összehasonlítását valós körülmények között.

A caching stratégiák jelentős teljesítményjavulást eredményezhetnek. A Content Delivery Network (CDN) használata csökkenti a válaszidőket és a szerver terhelést.

"A valódi hiperskálázhatóság nem csak a technológiáról szól, hanem arról, hogyan gondolkodunk a rendszerek tervezéséről és működtetéséről."

Adatbázis-skálázás kihívásai

Az adatbázis-skálázás az egyik legkomplexebb kihívás a hiperskálázható rendszerekben. A read replicas használata javítja az olvasási teljesítményt, míg a sharding lehetővé teszi a horizontális skálázást.

A NoSQL adatbázisok, mint a MongoDB, Cassandra vagy DynamoDB, természetesen támogatják a horizontális skálázást. A NewSQL megoldások megpróbálják kombinálni a relációs adatbázisok ACID tulajdonságait a NoSQL skálázhatóságával.

A database as a service (DBaaS) megoldások automatizálják a skálázást és karbantartást, de korlátozhatják a testreszabási lehetőségeket.

Hibakezelés és katasztrófa utáni helyreállítás

A hiperskálázható rendszerekben a hibatűrés kritikus fontosságú. A circuit breaker pattern megakadályozza, hogy egy komponens hibája az egész rendszert megbénítsa.

A chaos engineering elvei szerint szándékosan hibákat vezetünk be a rendszerbe, hogy teszteljük annak ellenállóképességét. A Netflix által kifejlesztett Chaos Monkey eszköz példa erre a megközelítésre.

A multi-region deployment biztosítja a magas rendelkezésre állást és katasztrófa utáni helyreállítást. A disaster recovery tervek részletes forgatókönyveket tartalmaznak különböző hibatípusokra.

"A hibák nem kivételek, hanem a rendszer normális működésének részei. A jó architektúra ezt figyelembe veszi."

Backup és helyreállítási stratégiák

Az automatizált backup rendszerek biztosítják az adatok rendszeres mentését. A point-in-time recovery lehetővé teszi az adatok visszaállítását egy adott időpontra.

A 3-2-1 backup rule szerint három másolatot kell készíteni, két különböző médiumon, és egy másolatot távoli helyen kell tárolni. A cross-region replication automatikusan replikálja az adatokat több földrajzi régióba.

A recovery time objective (RTO) és recovery point objective (RPO) metrikák segítenek meghatározni a backup és helyreállítási stratégiákat.

Költség-haszon elemzés

A hiperskálázható felhő befektetési megtérülése (ROI) több tényezőtől függ. A kezdeti implementációs költségek magasak lehetnek, de hosszú távon jelentős megtakarítások érhetők el.

A OpEx vs CapEx modell változása lehetővé teszi a rugalmasabb pénzügyi tervezést. A hagyományos infrastruktúra nagy kezdeti beruházást igényel (CapEx), míg a felhő folyamatos működési költségekkel jár (OpEx).

A total cost of ownership (TCO) számítása figyelembe veszi az összes kapcsolódó költséget, beleértve a személyzeti költségeket, képzéseket és karbantartást is.

Költségoptimalizálási technikák

A reserved instances és savings plans hosszú távú elköteleződést igényelnek, cserébe jelentős kedvezményeket kínálnak. A spot instances használata további megtakarítást eredményezhet alkalmas workloadok esetén.

A auto-shutdown politikák automatikusan leállítják a nem használt erőforrásokat. A resource tagging segít nyomon követni és optimalizálni a költségeket szervezeti egységek vagy projektek szerint.

A cost allocation és chargeback mechanizmusok biztosítják, hogy minden részleg vagy projekt viselје saját felhőköltségeit.

"A költségoptimalizálás nem egyszeri feladat, hanem folyamatos folyamat, amely állandó figyelmet és finomhangolást igényel."

Jövőbeli trendek és fejlődési irányok

A hiperskálázható felhő technológia folyamatosan fejlődik. A serverless computing egyre népszerűbb, ahol a fejlesztők csak a kódra koncentrálnak, az infrastruktúra kezelése teljes mértékben automatizált.

Az edge computing közelebb hozza a számítási erőforrásokat a felhasználókhoz, csökkentve a késleltetést és javítva a teljesítményt. A 5G technológia tovább gyorsítja ezt a trendet.

A quantum computing és neuromorphic computing új paradigmákat hozhatnak a hiperskálázhatóságba. Ezek a technológiák jelenleg még kísérleti fázisban vannak, de forradalmasíthatják a számítási képességeket.

Mesterséges intelligencia integráció

Az AI-driven infrastructure automatikusan optimalizálja az erőforrás-allokációt és előrejelzi a jövőbeli igényeket. A machine learning algoritmusok folyamatosan tanulnak a rendszer viselkedéséből.

Az AIOps (Artificial Intelligence for IT Operations) platformok automatizálják a hagyományosan manuális IT-műveleteket. Ezek az eszközök képesek anomáliákat észlelni, problémákat diagnosztizálni és javító intézkedéseket javasolni.

A natural language processing lehetővé teszi, hogy természetes nyelvű parancsokkal irányítsuk az infrastruktúrát.

"A jövő hiperskálázható rendszerei nem csak reagálnak a változásokra, hanem előre látják és megelőzik azokat."

Gyakorlati esettanulmányok és példák

A Netflix az egyik legismertebb példa a sikeres hiperskálázható architektúrára. A vállalat mikroszolgáltatás-alapú megközelítést használ és évente több ezer deployment-et hajt végre.

Az Airbnb dinamikusan skálázza infrastruktúráját a szezonális ingadozások kezelésére. A foglalási csúcsok alatt automatikusan növeli a kapacitást, majd csökkenti azt a csendesebb időszakokban.

A Spotify több millió felhasználó zenei élményét biztosítja hiperskálázható mikroszolgáltatások segítségével. A vállalat "squad" modellje lehetővé teszi a független csapatok gyors fejlesztését és telepítését.

E-commerce platformok skálázása

Az Amazon saját e-commerce platformja példa arra, hogyan lehet kezelni a Black Friday-szerű forgalmi csúcsokat. A vállalat prediktív algoritmusokat használ a várható terhelés előrejelzésére.

A Shopify több mint egymillió online áruház infrastruktúráját biztosítja hiperskálázható megoldásokkal. A platform automatikusan kezeli a forgalmi ingadozásokat anélkül, hogy az ügyfelek észrevennék.

Az eBay mikroszolgáltatás-alapú architektúrája lehetővé teszi a független komponensek skálázását az igények szerint.

Implementációs roadmap és best practice-ek

A sikeres hiperskálázható felhő implementáció lépésről lépésre történő megközelítést igényel. Az első fázisban fel kell mérni a jelenlegi infrastruktúrát és azonosítani a skálázási igényeket.

A proof of concept (PoC) fázisban kis léptékben teszteljük a hiperskálázható megoldásokat. Ez lehetővé teszi a tanulást és a kockázatok minimalizálását a teljes implementáció előtt.

A change management kritikus fontosságú a sikeres átálláshoz. A csapatoknak új készségeket kell elsajátítaniuk és új folyamatokat kell kialakítaniuk.

Csapat felkészítés és képzés

A DevOps kultúra kialakítása elengedhetetlen a hiperskálázható környezetben. A fejlesztési és üzemeltetési csapatoknak szorosan együtt kell működniük.

A cloud certification programok segítenek a csapattagoknak elsajátítani a szükséges ismereteket. Az AWS, Azure és GCP mind kínál átfogó képzési programokat.

A hands-on training és hackathon események gyakorlati tapasztalatot biztosítanak az új technológiákkal.

Mik a hiperskálázható felhő fő előnyei?

A hiperskálázható felhő automatikus erőforrás-allokációt, költségoptimalizálást, magas rendelkezésre állást és rugalmasságot biztosít. Lehetővé teszi a gyors reagálást a változó üzleti igényekre anélkül, hogy jelentős infrastrukturális beruházásokat kellene tenni.

Mennyibe kerül a hiperskálázható felhő implementációja?

A költségek nagyon változóak és függenek a szervezet méretétől, komplexitásától és igényeitől. A kezdeti implementáció költsége lehet néhány ezer dollártól több millió dollárig, de a hosszú távú megtakarítások jelentősek lehetnek.

Mennyi idő alatt lehet implementálni?

Az implementáció időtartama 3 hónaptól 2 évig terjedhet a projekt komplexitásától függően. Egy egyszerű lift-and-shift migráció néhány hónap alatt megvalósítható, míg egy teljes refactoring több évet is igénybe vehet.

Milyen biztonsági kockázatokat rejt magában?

A fő biztonsági kockázatok közé tartozik a nem megfelelő hozzáférés-kezelés, az adatszivárgás, a konfigurációs hibák és a shared responsibility model félreértése. Ezek megfelelő tervezéssel és implementációval minimalizálhatók.

Mely iparágak profitálhatnak leginkább belőle?

Különösen hasznos az e-commerce, média és szórakoztatás, fintech, gaming, IoT és SaaS szektorokban, ahol nagy a forgalmi ingadozás és gyors skálázásra van szükség.

Hogyan választjam ki a megfelelő szolgáltatót?

A választás során figyelembe kell venni a szolgáltatások széles körét, az árazási modellt, a földrajzi elérhetőséget, a compliance követelményeket, a támogatás minőségét és a meglévő technológiai stackkel való kompatibilitást.