A modern technológia világában egyre gyakrabban hallunk a mesterséges intelligenciáról és a neurális hálózatokról, amelyek forradalmasítják az életünket. Ezek a komplex rendszerek azonban mind egy alapvető építőelemre épülnek, amely nélkül a mai AI-forradalom elképzelhetetlen lenne. Ez az építőelem a perceptron, amely a gépi tanulás és a mesterséges neurális hálózatok történetének egyik legfontosabb mérföldköve.

A perceptron egy olyan matematikai modell, amely az emberi agy neuronjai működését utánozza egyszerűsített formában. Frank Rosenblatt által 1957-ben kifejlesztett algoritmus képes bináris osztályozási feladatok megoldására, és lineárisan szeparálható problémák esetén garantáltan konvergál a helyes megoldáshoz. Bár első pillantásra egyszerűnek tűnhet, a perceptron megértése kulcsfontosságú a modern deep learning és a komplex neurális architektúrák működésének megismeréséhez.

Az alábbi részletes elemzés során megismerkedhetsz a perceptron matematikai alapjaival, gyakorlati alkalmazásaival és korlátaival. Megtudhatod, hogyan fejlődött ez az alapmodell a mai többrétegű hálózatokká, és hogyan használhatod fel ezt a tudást saját gépi tanulási projektjeidben.

A Perceptron alapvető felépítése és működési elve

A perceptron egy egyrétegű neurális hálózat, amely bemeneti jeleket fogad, súlyozza őket, majd egy aktivációs függvény segítségével dönt a kimeneti értékről. Ez a folyamat meglepően hasonlít az emberi neuronok működésére, ahol a dendritek fogadják a jeleket, a sejttörzs feldolgozza azokat, az axon pedig továbbítja az eredményt.

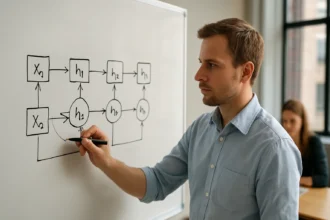

Az algoritmus három fő komponensből áll: a bemeneti réteg, amely az adatokat fogadja, a súlyvektor, amely meghatározza az egyes bemenetek fontosságát, valamint az aktivációs függvény, amely a végső döntést hozza. A matematikai reprezentáció szerint a perceptron kimenete y = f(∑(wi × xi) + b), ahol wi a súlyok, xi a bemenetek, b a bias, f pedig az aktivációs függvény.

A tanulási folyamat során a perceptron iteratív módon módosítja a súlyokat a hibák alapján. Ha a modell hibás előrejelzést ad, a súlyok frissülnek a perceptron tanulási szabály szerint: wi(új) = wi(régi) + α × (cél – kimenet) × xi, ahol α a tanulási ráta.

Bemeneti adatok feldolgozása

A perceptron bemeneti adatként numerikus értékeket fogad, amelyek lehetnek folytonosak vagy diszkrétek. Ezek az értékek reprezentálhatnak képpontokat, szöveges jellemzőket, vagy bármilyen más mérhető tulajdonságot, amely releváns a klasszifikációs feladat szempontjából.

A bemeneti vektor minden eleme egy-egy jellemzőt képvisel, amelyet a modell figyelembe vesz a döntéshozatal során. A dimenzionalitás tetszőleges lehet, bár a gyakorlatban a számítási komplexitás növekedése miatt érdemes optimalizálni a jellemzők számát.

Az adatok előfeldolgozása kritikus fontosságú a perceptron hatékony működéséhez. A normalizálás, standardizálás és a kiugró értékek kezelése jelentősen befolyásolhatja a tanulási folyamat sikerességét.

Súlyok és bias szerepe

A súlyvektor elemei határozzák meg, hogy az egyes bemeneti jellemzők mennyire fontosak a klasszifikációs döntés szempontjából. Pozitív súlyok növelik, negatív súlyok csökkentik a kimenet valószínűségét az adott bemenet függvényében.

A bias (eltolás) paraméter lehetővé teszi a döntési határ eltolását a koordináta-rendszer origójától függetlenül. Ez különösen fontos olyan esetekben, amikor az osztályok nem szimmetrikusan helyezkednek el a jellemzőtérben.

A súlyok inicializálása véletlenszerűen történik, általában kis értékekkel a numerikus stabilitás biztosítása érdekében. A tanulási folyamat során ezek az értékek fokozatosan finomhangolódnak a tréning adatok alapján.

Aktivációs függvények és döntéshozatal

Az aktivációs függvény határozza meg, hogyan alakítja át a perceptron a súlyozott bemenetek összegét végső kimenetté. A klasszikus perceptronban ez egy egyszerű lépcsős függvény, amely 0 vagy 1 értéket ad vissza egy küszöbérték alapján.

A sigmoid függvény simább átmenetet biztosít 0 és 1 között, ami hasznos lehet bizonyos alkalmazásokban. A ReLU (Rectified Linear Unit) függvény pedig a modern neurális hálózatokban vált népszerűvé egyszerűsége és hatékonysága miatt.

A döntési határ geometriailag egy hipersíkot képvisel a jellemzőtérben, amely elválasztja a különböző osztályokat egymástól. A perceptron célja ennek a hipersíknak az optimális pozicionálása a tréning adatok alapján.

| Aktivációs függvény | Képlet | Alkalmazási terület |

|---|---|---|

| Lépcsős | f(x) = 1 ha x ≥ 0, különben 0 | Bináris klasszifikáció |

| Sigmoid | f(x) = 1/(1+e^(-x)) | Valószínűségi kimenet |

| ReLU | f(x) = max(0,x) | Regresszió, modern hálózatok |

Lineáris szeparálhatóság

A perceptron egyik legfontosabb korlátja, hogy csak lineárisan szeparálható problémákat tud megoldani. Ez azt jelenti, hogy a különböző osztályok egyenes vonallal (vagy magasabb dimenziókban hipersíkkal) elválaszthatóak kell, hogy legyenek.

Klasszikus példa erre az AND és OR logikai műveletek, amelyeket a perceptron sikeresen meg tud tanulni. Az XOR művelet azonban nem lineárisan szeparálható, ezért egyetlen perceptron nem képes megoldani ezt a problémát.

A lineáris szeparálhatóság hiánya vezetett a többrétegű perceptronok (MLP) fejlesztéséhez, amelyek rejtett rétegek hozzáadásával képesek nemlineáris problémák megoldására is.

Tanulási algoritmus és konvergencia

A perceptron tanulási algoritmusa iteratív folyamat, amely során a modell fokozatosan javítja a teljesítményét a hibás klasszifikációk alapján. Az algoritmus garantáltan konvergál, ha az adatok lineárisan szeparálhatóak, és megfelelő tanulási rátát választunk.

A tanulási ráta (α) kritikus paraméter, amely meghatározza a súlyfrissítések mértékét. Túl nagy érték esetén a modell instabillá válhat, túl kicsi érték mellett pedig lassú lesz a konvergencia.

Az epochok száma meghatározza, hányszor tekinti át a modell a teljes tréning adathalmazt. A korai megállítás technikája segíthet elkerülni a túltanulást, különösen kisebb adathalmazok esetén.

"A perceptron tanulási szabálya elegánsan egyszerű, mégis hatékony: csak akkor módosítja a súlyokat, amikor hibát követ el, és mindig a helyes irányba korrigál."

Hibafüggvény és optimalizáció

A perceptron hibafüggvénye általában a hibásan klasszifikált minták számán vagy a hibák összegén alapul. Ez a függvény nem mindig differenciálható, ami korlátozza az optimalizációs technikák alkalmazhatóságát.

A gradiens alapú optimalizáció helyett a perceptron a hibák közvetlen korrekciójára épít. Ez egyszerűbbé teszi az implementációt, de korlátozza a finomhangolás lehetőségeit.

A stochasztikus gradiens ereszkedés (SGD) modern változatai jelentős javulást hoztak a konvergencia sebességében és stabilitásában, különösen nagy adathalmazok esetén.

Gyakorlati implementáció és alkalmazások

A perceptron implementálása viszonylag egyszerű, és számos programozási nyelvben elérhető. Python esetén a NumPy könyvtár biztosítja a szükséges matematikai műveleteket, míg a scikit-learn készen tartalmazza az optimalizált implementációt.

Az adatelőkészítés során fontos figyelmet fordítani a jellemzők skálázására és a hiányzó értékek kezelésére. A kategorikus változók numerikus reprezentációja szintén kritikus a modell megfelelő működéséhez.

A modell teljesítményének értékelése során használhatjuk a pontosságot, precizitást, visszahívást és F1-score metrikákat. A keresztvalidáció segít objektív képet kapni a modell általánosítási képességéről.

# Példa implementáció Python-ban

import numpy as np

class Perceptron:

def __init__(self, learning_rate=0.01, epochs=100):

self.learning_rate = learning_rate

self.epochs = epochs

def fit(self, X, y):

self.weights = np.random.normal(0, 0.01, X.shape[1])

self.bias = 0

for epoch in range(self.epochs):

for i in range(X.shape[0]):

prediction = self.predict_single(X[i])

error = y[i] - prediction

self.weights += self.learning_rate * error * X[i]

self.bias += self.learning_rate * error

Valós alkalmazási területek

A perceptron széles körben alkalmazható egyszerű klasszifikációs feladatokra. Az email spam szűrés egyik legkorábbi megközelítése perceptron alapú volt, ahol a szavak gyakorisága szolgált bemeneti jellemzőként.

Orvosi diagnosztikában a perceptron segíthet egyszerű döntési feladatokban, például laboratóriumi eredmények alapján történő előszűrésben. A pénzügyi szektorban hitelkockázat értékelésére is használható.

Képfeldolgozásban az egyszerű mintázatfelismerési feladatok, mint például karakterfelismerés vagy alapvető objektumdetektálás, szintén a perceptron alkalmazási területei közé tartoznak.

| Alkalmazási terület | Bemeneti jellemzők | Kimenet |

|---|---|---|

| Spam szűrés | Szavak gyakorisága | Spam/nem spam |

| Orvosi diagnosztika | Laboratóriumi értékek | Pozitív/negatív |

| Hitelértékelés | Pénzügyi mutatók | Jóváhagyás/elutasítás |

A Perceptron korlátai és fejlődése

A perceptron legfőbb korlátja a lineáris szeparálhatóság követelménye, amely jelentősen behatárolja az alkalmazási területeket. Minsky és Papert 1969-es könyve, a "Perceptrons" részletesen bemutatta ezeket a korlátokat, ami időlegesen lelassította a neurális hálózatok kutatását.

Az XOR probléma klasszikus példája annak, hogy a perceptron nem képes minden logikai függvényt megtanulni. Ez a felismerés vezetett a többrétegű architektúrák fejlesztéséhez, amelyek rejtett rétegek hozzáadásával képesek nemlineáris problémák megoldására.

A backpropagation algoritmus felfedezése az 1980-as években újra felélénkítette a neurális hálózatok kutatását, és lehetővé tette a mély hálózatok hatékony tanítását.

"A perceptron korlátai nem gyengeségek, hanem fontos tanulságok voltak, amelyek a modern mesterséges intelligencia fejlődésének irányát határozták meg."

Többrétegű perceptronok (MLP)

A többrétegű perceptron (Multi-Layer Perceptron) a klasszikus perceptron természetes kiterjesztése, amely egy vagy több rejtett réteget tartalmaz. Ez lehetővé teszi nemlineáris függvények approximálását és összetettebb problémák megoldását.

Az univerzális approximációs tétel szerint egy rejtett rétegű MLP tetszőleges folytonos függvényt meg tud közelíteni megfelelő pontossággal, ha elegendő neuronnal rendelkezik. Ez forradalmasította a gépi tanulás lehetőségeit.

A backpropagation algoritmus lehetővé teszi a gradiens hatékony számítását a teljes hálózaton keresztül, ami elengedhetetlen a súlyok optimalizálásához többrétegű architektúrákban.

Modern fejlesztések

A modern deep learning rendszerek a perceptron alapelveit használják, de számos újítással egészítik ki. A dropout regularizáció, batch normalizáció és speciális aktivációs függvények jelentősen javították a teljesítményt.

A konvolúciós neurális hálózatok (CNN) képfeldolgozásban, a rekurrens hálózatok (RNN) szekvenciális adatok kezelésében, a transformer architektúrák pedig természetes nyelvfeldolgozásban hoztak áttörést.

Az attention mechanizmusok és a self-attention bevezetése új lehetőségeket nyitott meg a komplex mintázatok felismerésében, különösen a gépi fordítás és szövegértés területén.

Optimalizációs technikák és finomhangolás

A perceptron teljesítményének optimalizálása során számos technika alkalmazható. A tanulási ráta ütemezése lehetővé teszi az adaptív tanulást, ahol az algoritmus fokozatosan csökkenti a lépésméret a konvergencia közelében.

A momentum technika segít elkerülni a lokális minimumokban való elakadást azáltal, hogy figyelembe veszi a korábbi súlyfrissítések irányát. Ez különösen hasznos zajos vagy ingadozó hibafüggvények esetén.

A regularizáció technikák, mint az L1 és L2 regularizáció, segítenek megelőzni a túltanulást azáltal, hogy büntetik a túl nagy súlyértékeket. Ez javítja a modell általánosítási képességét.

"Az optimalizáció művészet és tudomány egyaránt: a megfelelő technikák kiválasztása gyakran döntő a projekt sikerében."

Hiperparaméter hangolás

A hiperparaméterek optimális beállítása kritikus fontosságú a perceptron hatékony működéséhez. A tanulási ráta, epochok száma és a regularizációs paraméterek gondos megválasztása jelentősen befolyásolja a végeredményt.

A grid search és random search módszerek szisztematikus megközelítést biztosítanak a hiperparaméter-térben való kereséshez. A Bayesian optimalizáció még hatékonyabb alternatívát kínál kisebb számítási költséggel.

A keresztvalidáció elengedhetetlen a hiperparaméterek objektív értékeléséhez, mivel megakadályozza a túloptimalizálást a validációs halmazon.

Összehasonlítás más algoritmusokkal

A perceptron teljesítményét érdemes összehasonlítani más klasszifikációs algoritmusokkal, mint a logisztikus regresszió, támogatóvektor-gépek (SVM) vagy döntési fák. Minden algoritmusnak megvannak a maga előnyei és hátrányai.

A logisztikus regresszió hasonló matematikai alapokon nyugszik, de valószínűségi kimenetet biztosít, ami hasznos lehet bizonytalanság-becsléshez. Az SVM robosztusabb a kiugró értékekkel szemben és képes nemlineáris problémák megoldására is kernel trükkök segítségével.

A döntési fák értelmezhetőbbek és nem igényelnek jellemző-skálázást, de hajlamosak a túltanulásra. Az ensemble módszerek, mint a random forest, kombinálják több algoritmus előnyeit.

"A perceptron egyszerűsége egyben erőssége is: könnyen érthető, gyorsan implementálható és hatékony alapvető problémák megoldására."

Teljesítmény metrikák

A klasszifikációs teljesítmény értékelése során több metrikát is figyelembe kell venni. A pontosság (accuracy) az alapvető mérőszám, de kiegyensúlyozatlan adathalmazok esetén félrevezető lehet.

A precizitás és visszahívás (recall) metrikák részletesebb képet adnak a modell teljesítményéről különböző osztályok esetén. Az F1-score ezek harmonikus átlaga, amely kiegyensúlyozott értékelést biztosít.

A ROC görbe és az AUC (Area Under Curve) különösen hasznosak bináris klasszifikációs problémák esetén, mivel küszöbfüggetlen értékelést tesznek lehetővé.

Jövőbeli irányok és kutatási területek

A perceptron alapelvei továbbra is relevánsak a modern mesterséges intelligencia kutatásában. A neuromorphic computing területén hardver szinten próbálják megvalósítani a neuron-szerű számítási egységeket.

A quantum machine learning új lehetőségeket kínál a klasszikus perceptron modell kvantummechanikai kiterjesztésére. Ez potenciálisan exponenciális gyorsulást hozhat bizonyos problématípusok esetén.

A few-shot learning és meta-learning területeken a perceptron-szerű architektúrák gyors adaptációs képessége különösen értékes lehet új feladatok megtanulásában.

"A perceptron öröksége nem csak a múltban rejlik, hanem a jövő mesterséges intelligenciájának alapjait is meghatározza."

Biológiai inspirációk

Az emberi agy működésének mélyebb megértése új inspirációkat ad a perceptron modell továbbfejlesztéséhez. A spike timing dependent plasticity (STDP) mechanizmusok beépítése reálisabb tanulási szabályokat eredményezhet.

A dendritikus számítások figyelembevétele összetettebb bemeneti feldolgozást tesz lehetővé egyetlen neuron szintjén. Ez új architektúrák fejlesztéséhez vezethet, amelyek hatékonyabbak lehetnek a hagyományos megközelítéseknél.

A glial sejtek szerepének megértése szintén új perspektívákat nyithat a neurális hálózatok működésének optimalizálásában.

Mi a különbség a perceptron és a neuron között?

A perceptron egy matematikai modell, amely az emberi neuron működését utánozza egyszerűsített formában. A biológiai neuron összetett elektrokémiai folyamatokat használ, míg a perceptron lineáris kombinációt és aktivációs függvényt alkalmaz.

Miért nem tud a perceptron XOR műveletet megtanulni?

Az XOR művelet nem lineárisan szeparálható, azaz nem lehet egyenes vonallal elválasztani a különböző kimenetű pontokat a bemeneti térben. A perceptron csak lineáris döntési határokat tud létrehozni.

Hogyan választjuk meg a megfelelő tanulási rátát?

A tanulási ráta megválasztása iteratív folyamat. Túl nagy érték instabilitáshoz, túl kicsi érték lassú konvergenciához vezet. Általában 0.001 és 0.1 között érdemes kezdeni, majd finomhangolni.

Mikor érdemes perceptront használni más algoritmusok helyett?

A perceptron ideális egyszerű bináris klasszifikációs feladatokra, ahol az adatok lineárisan szeparálhatóak, gyors tanításra van szükség, és értelmezhetőség fontos szempont.

Hogyan kezelhetjük a nem lineárisan szeparálható problémákat?

Többrétegű perceptronok (MLP) használatával, kernel módszerekkel, vagy az adatok magasabb dimenziós térbe való transzformálásával tehetjük lineárisan szeparálhatóvá a problémát.

Milyen előfeldolgozási lépések szükségesek a perceptron használata előtt?

Az adatok normalizálása vagy standardizálása, hiányzó értékek kezelése, kategorikus változók numerikus kódolása, és a kiugró értékek azonosítása és kezelése elengedhetetlen.