Az információs társadalom egyik legnagyobb kihívása, hogy az adatok valós idejű feldolgozása egyre kritikusabbá válik minden iparágban. Gondoljunk csak a pénzügyi kereskedésre, ahol egy milliszekundumnyi késés milliókat jelenthet, vagy az orvosi diagnosztikára, ahol az azonnali eredmények életeket menthetnek meg.

Az adat késleltetés lényegében azt jelenti, hogy mennyi idő telik el attól a pillanattól, amikor egy adat keletkezik, egészen addig, amíg feldolgozásra vagy felhasználásra kerül. Ez a fogalom azonban sokkal összetettebb, mint első ránézésre tűnik, hiszen számos tényező befolyásolja, és különböző kontextusokban eltérő jelentéssel bír.

Ebben az átfogó útmutatóban minden fontos aspektust megvizsgálunk: a technikai alapoktól kezdve a mérési módszereken át egészen a gyakorlati optimalizálási stratégiákig. Megtudhatod, hogyan azonosítsd a késleltetés forrásait, milyen eszközökkel mérheted pontosan, és hogyan javíthatod rendszered teljesítményét.

Mi az adat késleltetés valójában?

A data latency alapvetően az időbeli távolságot jelenti az adatok életciklusában. Amikor egy szenzor mérést végez, egy felhasználó kattint, vagy egy tranzakció történik, az adat útja csak akkor kezdődik el. A késleltetés minden egyes lépésben felhalmozódik: az adatgyűjtéstől a továbbításon át a feldolgozásig és a végső felhasználásig.

A fogalom megértéséhez fontos különbséget tenni a különböző késleltetési típusok között. A hálózati késleltetés az adatok fizikai továbbítására vonatkozik, míg a feldolgozási késleltetés a számítási műveletek időigényét jelenti.

A késleltetés összetevői:

- Adatgyűjtési idő (szenzor válaszidő, mintavételezés)

- Hálózati továbbítási idő

- Feldolgozási és számítási idő

- Tárolási és lekérdezési idő

- Megjelenítési és felhasználói interfész idő

Késleltetési típusok részletesen

Hálózati késleltetés

A hálózati infrastruktúra jelentős szerepet játszik az összesített késleltetésben. A fizikai távolság, a hálózati eszközök száma és a sávszélesség mind befolyásolják az adatok utazási idejét. A modern hálózatokban a fény sebessége jelenti a fizikai korlátot, de a gyakorlatban a routerek, switchek és tűzfalak további késleltetést okoznak.

Az internet gerincvezetékein az adatok fénysebességgel utaznak, ami körülbelül 200 000 km/s optikai kábelben. Ez azt jelenti, hogy egy adat New Yorkból Londonba körülbelül 28 milliszekundum alatt érkezik meg, de a valóságban ez gyakran 100-150 milliszekundum közötti értékeket mutat a hálózati eszközök miatt.

Feldolgozási késleltetés

A számítási kapacitás és az algoritmusok hatékonysága közvetlenül befolyásolja, hogy mennyi ideig tart az adatok feldolgozása. A komplex elemzések, machine learning modellek vagy adatbázis-lekérdezések jelentős időt vehetnek igénybe. Modern processzorok esetében a cache memória elérése nanoszekundumokban mérhető, míg a RAM elérése már mikroszekundumokat vesz igénybe.

A párhuzamos feldolgozás lehetőségei jelentősen csökkenthetik ezt a típusú késleltetést. A GPU-alapú számítások vagy elosztott rendszerek használata nagyságrendekkel javíthatja a teljesítményt.

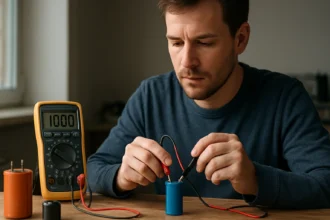

Mérési módszerek és eszközök

Aktív mérési technikák

Az aktív mérés során specifikus tesztcsomagokat küldünk a rendszeren keresztül, és mérjük a válaszidőket. A ping parancs a legegyszerűbb példa erre, amely ICMP csomagokat küld a célállomásra és méri a round-trip időt. Azonban ez csak a hálózati késleltetés egy részét mutatja meg.

A traceroute eszköz még részletesebb képet ad, mivel megmutatja minden egyes hálózati csomópont késleltetését az útvonal mentén. A modern alkalmazások számára azonban specifikusabb mérési eszközökre van szükség.

Népszerű mérőeszközök:

- Wireshark: Részletes csomagszintű elemzés

- iperf3: Hálózati sávszélesség és késleltetés mérés

- Apache JMeter: Alkalmazásszintű teljesítménytesztelés

- Grafana: Valós idejű monitoring és vizualizáció

- Nagios: Infrastruktúra monitoring

Passzív monitoring

A passzív megközelítés során a már meglévő forgalmat figyeljük anélkül, hogy további terhelést generálnánk. Ez különösen hasznos éles környezetekben, ahol a további tesztelés befolyásolhatná a felhasználói élményt. A log fájlok elemzése, a hálózati forgalom monitorozása és az alkalmazás-specifikus metrikák gyűjtése tartozik ide.

A modern APM (Application Performance Monitoring) eszközök automatikusan gyűjtik ezeket az adatokat és valós idejű dashboardokon jelenítik meg. Ez lehetővé teszi a problémák gyors azonosítását és a trendek követését.

Késleltetési követelmények iparágak szerint

| Iparág | Elfogadható késleltetés | Kritikus alkalmazások |

|---|---|---|

| Pénzügyi kereskedés | < 1 ms | Algoritmikus kereskedés |

| Online gaming | < 50 ms | Multiplayer játékok |

| Videokonferencia | < 150 ms | Valós idejű kommunikáció |

| IoT szenzorok | < 100 ms | Ipari automatizálás |

| Weboldal betöltés | < 3 s | Felhasználói élmény |

Pénzügyi szektor

A pénzügyi piacokon a high-frequency trading (HFT) algoritmusok mikroszekundumok alatt hoznak döntéseket. Egy milliszekundum előny jelentős versenyelőnyt jelenthet, ezért a kereskedési cégek milliárdokat költenek arra, hogy csökkentsék a késleltetést. A co-location szolgáltatások, ahol a szerverek fizikailag közel vannak a tőzsdei rendszerekhez, kifejezetten erre a célra szolgálnak.

A blokklánc technológia újabb kihívásokat hozott, ahol a tranzakció-visszaigazolási idők kritikus fontosságúak. A Bitcoin hálózatban egy tranzakció visszaigazolása átlagosan 10 percet vesz igénybe, míg újabb technológiák másodpercekre csökkentették ezt az időt.

Gaming és szórakoztatóipar

Az online játékokban a lag (késleltetés) közvetlenül befolyásolja a játékélményt. A kompetitív e-sport környezetben 20-30 milliszekundum késleltetés már érezhető hátrány lehet. A játékfejlesztők különböző technikákat alkalmaznak, mint a prediktív algoritmusok és a lag compensation, hogy minimalizálják a késleltetés hatását.

A streaming szolgáltatások esetében az adaptív bitrate technológia segít optimalizálni a késleltetést és a minőséget. A CDN (Content Delivery Network) hálózatok használata jelentősen csökkenti a földrajzi távolságból eredő késleltetést.

Optimalizálási stratégiák

Infrastruktúra szintű megoldások

A hardver választása alapvetően meghatározza a rendszer késleltetési karakterisztikáit. Az SSD tárolók használata a hagyományos merevlemezek helyett nagyságrendekkel csökkenti az I/O késleltetést. A modern NVMe SSD-k mikroszekundumos hozzáférési időket biztosítanak a milliszekundumos merevlemezekkel szemben.

A memória hierarchia optimalizálása szintén kritikus. A CPU cache-ek hatékony kihasználása, a NUMA (Non-Uniform Memory Access) architektúra figyelembevétele és a memória bandwidth optimalizálása mind hozzájárulnak a jobb teljesítményhez.

Infrastruktúra optimalizálási lehetőségek:

- Edge computing: Feldolgozás közelebb a felhasználókhoz

- CDN használata: Tartalom földrajzi elosztása

- Load balancing: Terhelés egyenletes elosztása

- Caching stratégiák: Gyakran használt adatok gyorsabb elérése

- Database indexing: Lekérdezések gyorsítása

Szoftver szintű optimalizálás

Az alkalmazás architektúra tervezése során figyelembe kell venni a késleltetési követelményeket. A microservices architektúra előnyei mellett hátránya lehet a szolgáltatások közötti kommunikáció okozta további késleltetés. Az asynchronous programozás és a non-blocking I/O használata jelentősen javíthatja a válaszidőket.

Az adatbázis optimalizálás kulcsfontosságú terület. A megfelelő indexek használata, a lekérdezések optimalizálása és a kapcsolati táblák hatékony tervezése mind hozzájárul a jobb teljesítményhez.

"A késleltetés optimalizálása nem egyszeri feladat, hanem folyamatos monitoring és finomhangolás eredménye."

Mérési metrikák és KPI-k

Alapvető metrikák

A késleltetés mérésében több standard metrika használatos. A round-trip time (RTT) a teljes oda-vissza utazási időt méri, míg a one-way latency csak az egy irányú késleltetést. A jitter a késleltetés ingadozását mutatja, ami különösen fontos a valós idejű alkalmazásoknál.

A percentilis alapú mérés pontosabb képet ad a rendszer teljesítményéről, mint az egyszerű átlag. A 95. vagy 99. percentilis megmutatja, hogy a felhasználók nagy része milyen teljesítményt tapasztal, míg az átlag eltakarhatja a kiugró értékeket.

Speciális metrikák

A Time to First Byte (TTFB) webalkalmazásoknál kritikus metrika, amely azt méri, hogy mennyi idő telik el a kérés elküldése és az első bájt megérkezése között. A Time to Interactive (TTI) pedig azt mutatja, hogy mikor válik a weboldal teljesen interaktívvá.

Az Application Response Time az alkalmazás szintű késleltetést méri, míg a Database Query Time specifikusan az adatbázis műveletek időigényét. Ezek kombinációja adja meg a teljes felhasználói élményt.

| Metrika típus | Mértékegység | Tipikus érték | Optimális érték |

|---|---|---|---|

| Hálózati RTT | milliszekundum | 50-200 ms | < 50 ms |

| Database Query | milliszekundum | 10-100 ms | < 10 ms |

| API Response | milliszekundum | 100-500 ms | < 100 ms |

| Web Page Load | másodperc | 2-5 s | < 2 s |

Monitoring és alerting

Valós idejű monitoring

A modern rendszerekben elengedhetetlen a folyamatos monitoring. Az olyan eszközök, mint a Prometheus, InfluxDB vagy DataDog, lehetővé teszik a metrikák valós idejű gyűjtését és elemzését. Az automatikus alerting rendszerek azonnal jelzik, ha a késleltetés meghaladja az elfogadható küszöbértékeket.

A distributed tracing technológia különösen hasznos mikroszolgáltatás architektúrákban, ahol egy kérés több szolgáltatáson keresztül halad. Az olyan eszközök, mint a Jaeger vagy Zipkin, részletes képet adnak arról, hogy melyik komponens okozza a késleltetést.

"A proaktív monitoring kulcsfontosságú a felhasználói élmény fenntartásában – mire a felhasználók panaszkodnak, már késő."

Prediktív elemzés

A machine learning algoritmusok használata lehetővé teszi a késleltetési problémák előrejelzését. Az idősor elemzés és anomália detektálás segítségével azonosíthatók a potenciális problémák még azelőtt, hogy azok befolyásolnák a felhasználókat.

A capacity planning során a historikus adatok elemzése alapján megjósolható, hogy mikor lesz szükség további erőforrásokra a megfelelő teljesítmény fenntartásához.

Cloud és edge computing hatása

Felhő alapú megoldások

A cloud computing paradigmaváltást hozott a késleltetés kezelésében. A multi-region deployment lehetővé teszi, hogy az alkalmazások közelebb legyenek a felhasználókhoz. Az AWS, Google Cloud és Microsoft Azure globális infrastruktúrája lehetővé teszi a milliszekundumos késleltetést világszerte.

A serverless architektúrák, mint az AWS Lambda vagy Google Cloud Functions, új kihívásokat hoztak a "cold start" problémával. Egy inaktív funkció első meghívása jelentős késleltetést okozhat, míg a "warm" funkciók gyorsan reagálnak.

Edge computing forradalma

Az edge computing a feldolgozást a hálózat szélére, közelebb a felhasználókhoz vagy adatforrásokhoz helyezi. Ez különösen fontos az IoT alkalmazásoknál, ahol a szenzorok adatait helyben kell feldolgozni a valós idejű döntéshozatalhoz.

A 5G hálózatok ultra-alacsony késleltetést ígérnek, amely új alkalmazási területeket nyit meg, mint az autonóm járművek vagy a távműtétek. A hálózati szeletálás (network slicing) lehetővé teszi különböző szolgáltatási szintek biztosítását ugyanazon a fizikai infrastruktúrán.

"Az edge computing nem csak a késleltetést csökkenti, hanem a sávszélesség használatot is optimalizálja azáltal, hogy csak a releváns adatokat továbbítja a központi rendszerekhez."

Jövőbeli trendek és technológiák

Kvantum kommunikáció

A kvantum kommunikáció ígéretes jövőbeli technológia, amely elméletileg azonnali információátvitelt tesz lehetővé. Bár még kutatási fázisban van, a kvantum entanglement jelenség kihasználása forradalmasíthatja az adatátvitelt.

A kvantum számítógépek fejlődése új lehetőségeket nyit meg a komplex optimalizálási problémák megoldásában, amelyek segíthetnek a hálózati útvonalak és az erőforrás-allokáció optimalizálásában.

Neuromorphic computing

A neuromorphic chipek az emberi agy működését utánozzák, és jelentősen alacsonyabb energiafogyasztás mellett képesek valós idejű feldolgozásra. Ez különösen ígéretes az edge computing alkalmazásokban, ahol az energiahatékonyság kritikus.

Az Intel Loihi és más neuromorphic processzorok már demonstrálták képességeiket a mintafelismerés és döntéshozatal terén mikroszekundumos késleltetéssel.

"A neuromorphic computing nem csak gyorsabb, hanem adaptívabb is – képes tanulni és optimalizálni saját működését a valós idejű követelmények alapján."

Biztonsági szempontok

Késleltetés és biztonság közötti egyensúly

A biztonsági intézkedések gyakran növelik a késleltetést. A titkosítás, hitelesítés és behatolás-érzékelés mind további feldolgozási időt igényelnek. A modern rendszerekben kritikus a megfelelő egyensúly megtalálása a biztonság és a teljesítmény között.

A hardware-alapú titkosítás, mint az AES-NI utasításkészlet, jelentősen csökkenti a titkosítás okozta késleltetést. A TLS 1.3 protokoll optimalizált handshake folyamata szintén javítja a kapcsolat felépítési időket.

DDoS támadások hatása

A Distributed Denial of Service támadások jelentősen megnövelhetik a késleltetést vagy teljesen elérhetetlenné tehetik a szolgáltatásokat. A modern DDoS védelmi megoldások, mint a Cloudflare vagy AWS Shield, képesek kiszűrni a rosszindulatú forgalmat anélkül, hogy jelentősen befolyásolnák a legitim kérések késleltetését.

A rate limiting és traffic shaping technikák segítenek fenntartani a szolgáltatás minőségét támadás alatt is.

"A biztonság és teljesítmény közötti egyensúly megtalálása a modern rendszertervezés egyik legnagyobb kihívása."

Gyakorlati implementációs útmutató

Mérési stratégia kialakítása

Az első lépés mindig a jelenlegi állapot felmérése. Azonosítani kell a kritikus útvonalakat és komponenseket, majd ezekre koncentrálva kell mérési pontokat kijelölni. A baseline metrikák meghatározása után lehet célokat kitűzni és optimalizálási stratégiát kidolgozni.

A monitoring infrastruktúra kiépítése során fontos figyelembe venni, hogy maga a monitoring ne okozzon jelentős overhead-et. A mintavételezési stratégia és az adatok aggregálása kulcsfontosságú a hatékony monitoring érdekében.

Optimalizálási prioritások

Nem minden késleltetési forrás egyformán kritikus. A Pareto-elv alapján általában a problémák 80%-át a források 20%-a okozza. Az első lépésben ezeket a kritikus pontokat kell azonosítani és optimalizálni.

A költség-haszon elemzés segít eldönteni, hogy mely optimalizálások érik meg a befektetést. Egy drága hardware upgrade helyett gyakran szoftver szintű optimalizálással is elérhetők jelentős javulások.

Optimalizálási sorrend:

- Bottleneck azonosítás: A leglassabb komponens megtalálása

- Quick wins: Egyszerűen megvalósítható javítások

- Infrastruktúra upgrade: Hardware fejlesztések

- Architektúra átdolgozás: Nagyobb strukturális változások

- Folyamatos finomhangolás: Monitoring alapú optimalizálás

Költség-hatékonyság elemzése

ROI számítás

A késleltetés csökkentésének üzleti értéke gyakran nehezen számszerűsíthető, de kritikus fontosságú. Az e-commerce szektorban jól dokumentált, hogy minden 100 milliszekundum késleltetés csökkentése 1%-kal növeli a konverziós rátát. A pénzügyi szektorban ez még drámaibb lehet.

A felhasználói elégedettség növekedése, a churn rate csökkenése és a produktivitás javulása mind hozzájárulnak a pozitív ROI-hoz. A downtime költségének csökkentése szintén jelentős megtakarítást eredményezhet.

Skálázhatósági megfontolások

Az optimalizálási megoldások skálázhatóságát is figyelembe kell venni. Egy megoldás, amely kis terhelés mellett jól működik, nagyobb terhelés alatt akár kontraproduktív is lehet. A load testing és capacity planning elengedhetetlen a hosszú távú siker érdekében.

A cloud-based megoldások általában jobb skálázhatóságot biztosítanak, de a költségek exponenciálisan növekedhetnek. A hybrid megközelítések gyakran optimális egyensúlyt biztosítanak a költség és teljesítmény között.

"A legdrágább optimalizálás az, amely nem skálázódik – a rövid távú nyereség hosszú távú problémákká válhat."

Milyen típusú késleltetések léteznek?

A fő típusok: hálózati késleltetés (adatok továbbítása), feldolgozási késleltetés (számítási műveletek), tárolási késleltetés (disk/memória hozzáférés), és alkalmazás szintű késleltetés (szoftver logika futtatása).

Hogyan mérhető pontosan a késleltetés?

Aktív mérési eszközökkel (ping, traceroute, iperf), passzív monitoring rendszerekkel (APM eszközök), és alkalmazás-specifikus metrikákkal (API response time, database query time). Fontos a percentilis alapú mérés használata az átlag helyett.

Milyen eszközök ajánlottak a monitoring-hoz?

Népszerű eszközök: Grafana (vizualizáció), Prometheus (metrika gyűjtés), Wireshark (hálózat elemzés), JMeter (terhelés teszt), és DataDog (teljes körű monitoring). A választás függ a specifikus igényektől és infrastruktúrától.

Mennyi késleltetés számít elfogadhatónak?

Ez alkalmazásfüggő: pénzügyi kereskedésnél < 1ms, online játékoknál < 50ms, weboldalak betöltésénél < 3s, videokonferenciánál < 150ms. A felhasználói elvárások és az iparági standardok határozzák meg.

Hogyan lehet csökkenteni a késleltetést?

Főbb módszerek: CDN használata, edge computing, caching stratégiák, database optimalizálás, hálózati infrastruktúra fejlesztés, és alkalmazás architektúra átdolgozás. A legnagyobb hatást általában a bottleneck komponensek optimalizálása hozza.

Mi a különbség a késleltetés és a sávszélesség között?

A késleltetés az időt méri (mennyi idő alatt érkezik meg az adat), míg a sávszélesség a kapacitást (mennyi adat továbbítható időegység alatt). Mindkettő fontos a teljesítményhez, de különböző problémákat oldanak meg.