A modern digitális világban minden pillanatban hatalmas mennyiségű adat keletkezik körülöttünk. Webhelyek látogatottsága, mobilalkalmazások használata, IoT eszközök mérési eredményei, pénzügyi tranzakciók – mind olyan információforrások, amelyek azonnali feldolgozást és elemzést igényelnek. A vállalkozások versenyképessége egyre inkább azon múlik, hogy milyen gyorsan tudják ezeket az adatokat értékteremtő betekintésekké alakítani.

Az Event Stream Processing egy olyan technológiai megközelítés, amely lehetővé teszi az adatok folyamatos, valós idejű feldolgozását és elemzését. Ellentétben a hagyományos batch feldolgozással, ahol az adatokat nagyobb csoportokban dolgozzuk fel időszakosan, az ESP minden egyes eseményt azonnal kezel, amint az beérkezik a rendszerbe. Ez a módszer többféle perspektívából is megközelíthető: technológiai, üzleti és architektúrális szempontból egyaránt.

Ebben az átfogó útmutatóban megismerkedhetsz az Event Stream Processing alapjaival, működési mechanizmusaival és gyakorlati alkalmazási lehetőségeivel. Megtudhatod, milyen szoftvereszközök állnak rendelkezésre, hogyan választhatsz közülük, és milyen kihívásokkal kell számolnod az implementáció során. Részletes betekintést nyersz a legmodernebb technikákba és eszközökbe, amelyek segítségével saját valós idejű adatelemzési rendszert építhetsz ki.

Az Event Stream Processing alapfogalmai

A valós idejű adatfeldolgozás világában az események (events) alkotják az alapvető építőelemeket. Minden esemény egy konkrét időpontban bekövetkezett változást vagy cselekvést reprezentál a rendszerben. Ezek lehetnek felhasználói interakciók, szenzor mérések, rendszerüzenetek vagy bármilyen más digitális nyom, amely időbélyeggel ellátható.

Az eseményfolyamok (event streams) olyan folyamatosan érkező adatsorozatok, amelyek időrendi sorrendben tartalmazzák ezeket az eseményeket. A stream processing paradigma lényege, hogy ezeket az adatokat nem tároljuk el feldolgozás előtt, hanem azonnal reagálunk rájuk. Ez fundamentálisan különbözik a hagyományos batch feldolgozástól, ahol először összegyűjtjük az adatokat, majd utána dolgozzuk fel őket.

"A valós idejű adatfeldolgozás nem csupán gyorsabb batch processing, hanem egy teljesen új gondolkodásmód az adatok kezeléséről."

Az alacsony késleltetés (low latency) kritikus követelmény az ESP rendszerekben. Míg a batch feldolgozás percekben vagy órákban méri a válaszidőt, addig a stream processing milliszekundumokban vagy másodpercekben. Ez lehetővé teszi olyan alkalmazások létrehozását, amelyek azonnal reagálnak a változásokra.

Valós idejű vs. közel valós idejű feldolgozás

A terminológia tisztázása kulcsfontosságú a megfelelő technológiai döntések meghozatalához. A valós idejű feldolgozás (real-time processing) szigorú időkorlátokat jelent, ahol a rendszernek garantálnia kell, hogy egy esemény feldolgozása meghatározott időn belül megtörténik. Ez különösen kritikus olyan alkalmazásoknál, mint az automatizált kereskedési rendszerek vagy az ipari vezérlőberendezések.

A közel valós idejű feldolgozás (near real-time processing) kevésbé szigorú követelményeket támaszt. Itt elfogadható néhány másodperc vagy perc késleltetés, ami még mindig jelentősen gyorsabb, mint a hagyományos batch feldolgozás. A legtöbb üzleti alkalmazás ebbe a kategóriába tartozik.

Az időablakozás (windowing) koncepciója központi szerepet játszik mindkét megközelítésben. Az időablakok segítségével csoportosíthatjuk az eseményeket meghatározott időintervallumokba, ami lehetővé teszi aggregációk és számítások elvégzését a folyamatosan érkező adatokon.

Stream Processing architektúrák és minták

A stream processing architektúrák tervezésekor több alapvető mintát alkalmazhatunk. A Lambda architektúra kombinál egy gyors stream processing réteget egy pontosabb batch processing réteggel. Ez biztosítja mind a gyors válaszidőt, mind a hosszú távú pontosságot, de komplexitása miatt karbantartási kihívásokat jelenthet.

A Kappa architektúra egyszerűbb megközelítést kínál, ahol minden adatfeldolgozás stream processing formájában történik. Ez csökkenti a rendszer komplexitását, de nagyobb teljesítményű infrastruktúrát igényel. Modern alkalmazásoknál gyakran ez a preferált választás.

Az Event Sourcing minta szerint minden változást eseményként tárolunk, ami teljes auditálhatóságot és visszajátszhatóságot biztosít. Ez különösen hasznos pénzügyi alkalmazásoknál vagy olyan rendszereknél, ahol kritikus a teljes történet nyomon követése.

| Architektúra típus | Előnyök | Hátrányok | Alkalmazási terület |

|---|---|---|---|

| Lambda | Gyors + pontos eredmények | Magas komplexitás | Nagy volumenű adatok |

| Kappa | Egyszerű karbantartás | Nagyobb erőforrásigény | Modern alkalmazások |

| Event Sourcing | Teljes auditálhatóság | Tárolási többletköltség | Pénzügyi rendszerek |

Apache Kafka: Az eseményfolyamok gerince

Az Apache Kafka az egyik legszélesebb körben használt platform az Event Stream Processing területén. Alapvetően egy elosztott eseménynapló (distributed event log), amely nagy teljesítményű, hibatűrő és horizontálisan skálázható adatfolyam-kezelést biztosít.

A Kafka topic alapú architektúrát használ, ahol minden topic egy kategóriát reprezentál az események számára. A partícionálás lehetővé teszi az adatok elosztását több szerver között, ami jelentősen növeli a teljesítményt és a hibatűrést. A replikáció mechanizmus biztosítja, hogy az adatok több példányban legyenek tárolva.

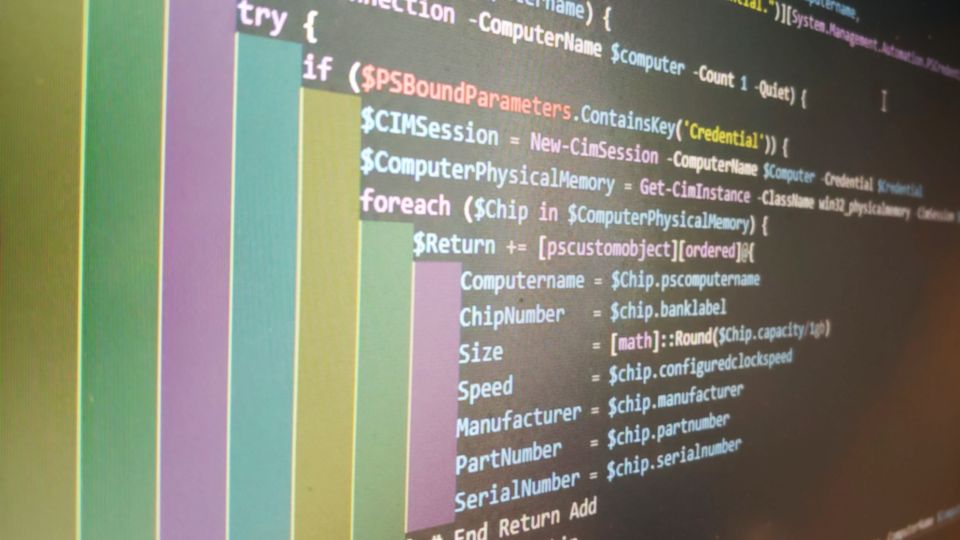

A Kafka Streams API-ja lehetővé teszi komplex stream processing alkalmazások fejlesztését Java vagy Scala nyelven. Beépített támogatást nyújt az időablakozáshoz, aggregációkhoz és join műveletekhez. A exactly-once semantics garantálja, hogy minden esemény pontosan egyszer kerül feldolgozásra.

"A Kafka nem csupán egy üzenetsor, hanem egy teljes értékű adatplatform, amely képes kezelni a vállalat összes eseményfolyamát."

A Kafka Connect ökoszisztéma számos előre elkészített connector-t biztosít különböző adatforrásokhoz és célrendszerekhez. Ez jelentősen leegyszerűsíti az integrációs feladatokat és csökkenti a fejlesztési időt.

Apache Storm és Apache Flink összehasonlítása

Az Apache Storm az egyik első nagy hatású stream processing framework volt. Tuple-alapú feldolgozási modellt használ, ahol az adatok kis csomagokban (tuples) áramlanak a topológián keresztül. A Storm garantálja az adatok feldolgozását, de nem nyújt exactly-once szemantikát alapértelmezésben.

A Storm spout és bolt komponensekből épül fel. A spout-ok az adatforrásokhoz kapcsolódnak és tuple-ket bocsátanak ki, míg a bolt-ok végzik a tényleges feldolgozási logikát. Ez a modell rugalmas, de komplex alkalmazásoknál nehezen kezelhető lehet.

Az Apache Flink modern alternatívát kínál fejlett stream processing képességekkel. Natív támogatást nyújt mind a stream, mind a batch feldolgozáshoz egyetlen API-n keresztül. A Flink DataStream API-ja expressziívebb és típusbiztos programozási modellt tesz lehetővé.

A Flink checkpoint mechanizmusa biztosítja az exactly-once feldolgozást és a hibák utáni automatikus helyreállítást. Az event-time processing támogatás lehetővé teszi a késleltetett vagy nem sorrendben érkező események helyes kezelését.

Spark Streaming: Micro-batch megközelítés

Az Apache Spark Streaming egy micro-batch architektúrát implementál, ahol a folyamatosan érkező adatokat kis batch-ekbe csoportosítja és dolgozza fel. Ez hibrid megközelítést jelent a valódi stream processing és a hagyományos batch feldolgozás között.

A DStream (Discretized Stream) absztrakció lehetővé teszi a stream adatok kezelését RDD-k (Resilient Distributed Datasets) sorozataként. Ez egységes programozási modellt biztosít, ahol ugyanazokat a transzformációkat alkalmazhatjuk, mint batch feldolgozásnál.

A Structured Streaming a Spark 2.0-ban bevezetett újabb API, amely DataFrame és Dataset absztrakciókat használ. Ez típusbiztos programozást tesz lehetővé és jobb teljesítményt nyújt a Catalyst optimizer révén.

"A Spark Streaming erőssége a Spark ökoszisztéma integrációjában rejlik, lehetővé téve az egységes adatfeldolgozási pipeline-ok építését."

A kontinuus feldolgozási mód (continuous processing) kísérleti funkció, amely valódi stream processing képességeket ad a Spark-hoz. Ez jelentősen csökkenti a késleltetést, de még nem minden funkció támogatott ebben a módban.

Amazon Kinesis és Google Cloud Dataflow

Az Amazon Kinesis teljes körű felhőalapú stream processing szolgáltatás. A Kinesis Data Streams nagy áteresztőképességű adatbevitelt tesz lehetővé, míg a Kinesis Analytics SQL-alapú stream feldolgozást biztosít. A Kinesis Data Firehose automatikus adatterhelést nyújt különböző AWS szolgáltatásokba.

A Kinesis előnye a teljes körű AWS integráció és a szerverless működési modell. Nincs szükség infrastruktúra menedzsmentre, és automatikusan skálázódik a terhelés alapján. A Kinesis Client Library (KCL) leegyszerűsíti a fogyasztó alkalmazások fejlesztését.

A Google Cloud Dataflow az Apache Beam programozási modellt implementálja felhőszolgáltatásként. A Beam egységes API-t biztosít mind stream, mind batch feldolgozáshoz, ami jelentősen egyszerűsíti a fejlesztést. A pipeline koncepció lehetővé teszi komplex adatfeldolgozási munkafolyamatok deklaratív leírását.

A Dataflow autoscaling képességei automatikusan igazítják az erőforrásokat a terheléshez. A exactly-once processing és a late data handling beépített támogatása robusztus alkalmazások fejlesztését teszi lehetővé.

| Platform | Programozási modell | Skálázhatóság | Késleltetés | Költségmodell |

|---|---|---|---|---|

| Kinesis | SQL + SDK | Automatikus | Alacsony | Pay-per-use |

| Dataflow | Apache Beam | Automatikus | Nagyon alacsony | Erőforrás-alapú |

| Kafka | Streams API | Manuális | Minimális | Infrastruktúra |

Komplex eseményfeldolgozás (CEP)

A Complex Event Processing olyan technika, amely lehetővé teszi minták felismerését és komplex szabályok alkalmazását eseményfolyamokon. Ez túlmegy az egyszerű szűrésen és aggregáción, képes időbeli kapcsolatok és eseménysorozatok azonosítására.

A CEP pattern matching képességei lehetővé teszik olyan helyzetek detektálását, mint a fraud észlelés, rendszermonitorozás vagy üzleti folyamatok optimalizálása. A temporal operators segítségével definiálhatunk időbeli korlátokat és sorrendiségeket.

Az Apache Flink CEP library gazdag mintafelismerési funkciókat biztosít. A Pattern API deklaratív módon teszi lehetővé komplex minták definiálását. A match timeout és iterative patterns támogatása rugalmas szabályrendszerek kialakítását teszi lehetővé.

"A komplex eseményfeldolgozás áthidalja a szakadékot a nyers adatok és az üzleti intelligencia között."

A state management kritikus komponens CEP alkalmazásokban, mivel a rendszernek emlékeznie kell a korábbi eseményekre a minták felismeréséhez. A megfelelő state partitioning és cleanup stratégiák nélkül a memóriahasználat gyorsan elszabadulhat.

Időablakozás és aggregációk

Az időablakozás (windowing) alapvető technika a stream processing-ben, amely lehetővé teszi véges csoportokba szervezni a végtelen eseményfolyamokat. Különböző ablaktípusok léteznek, mindegyik más-más használati esetekre optimalizált.

A tumbling windows (bukdácsoló ablakok) nem átfedő, egyenlő méretű időintervallumokat hoznak létre. Például 5 perces ablakok esetén minden esemény pontosan egy ablakba tartozik. Ez ideális egyszerű aggregációkhoz, mint például óránkénti összesítések.

A sliding windows (csúszó ablakok) átfedő ablakokat hoznak létre, ahol minden ablak egy kis lépéssel tolódik el. Például 10 perces ablakok 1 perces lépésekkel. Ez simább aggregációkat tesz lehetővé, de nagyobb számítási terhelést jelent.

A session windows eseményvezérelt ablakozást biztosítanak, ahol az ablak mérete a felhasználói aktivitás alapján változik. Az ablak bezárul, ha meghatározott ideig nem érkezik új esemény. Ez különösen hasznos webes analytics alkalmazásokban.

"A megfelelő ablakozási stratégia kiválasztása kritikus a stream processing alkalmazások teljesítménye és pontossága szempontjából."

Hibakezelés és hibatűrés

A stream processing rendszerek hibatűrése (fault tolerance) különleges kihívásokat jelent, mivel az adatok folyamatosan áramlanak és nem tárolódnak tartósan. A checkpoint mechanizmus az egyik legfontosabb technika, amely rendszeres pillanatképeket készít a feldolgozási állapotról.

A backpressure kezelés biztosítja, hogy a rendszer ne omoljon össze, ha a feldolgozási sebesség nem tud lépést tartani az adatbevitel sebességével. Ez lehet drop-based (események eldobása) vagy blocking-based (adatbevitel lassítása) stratégia.

A poison message problémák kezelése kritikus a rendszer stabilitása szempontjából. Olyan események, amelyek hibát okoznak a feldolgozás során, dead letter queue-ba kerülhetnek további vizsgálatra. A circuit breaker minta megakadályozza, hogy egyetlen hibás komponens megbénítsa az egész rendszert.

Az exactly-once processing garantálása komplex feladat elosztott környezetben. A két fázisú commit protokoll vagy idempotent operations használata szükséges a duplikált feldolgozás elkerülésére.

Teljesítményoptimalizálás és skálázás

A stream processing rendszerek teljesítményoptimalizálása többrétű megközelítést igényel. A partitioning strategy meghatározza, hogyan oszlanak el az adatok a feldolgozó csomópontok között. A key-based partitioning biztosítja, hogy a kapcsolódó események ugyanazon a csomóponton kerüljenek feldolgozásra.

A parallelization mértéke kritikus tényező a teljesítmény szempontjából. Túl kevés párhuzamosság esetén a rendszer nem használja ki a rendelkezésre álló erőforrásokat, míg túl sok párhuzamosság koordinációs overhead-et okoz.

A memory management különösen fontos stateful stream processing alkalmazásoknál. A RocksDB vagy hasonló embedded adatbázisok használata lehetővé teszi nagy mennyiségű state hatékony tárolását és elérését.

A network optimization jelentős hatással van a teljesítményre elosztott rendszerekben. A batch compression, connection pooling és async I/O technikák alkalmazása csökkentheti a hálózati késleltetést.

"A stream processing rendszerek optimalizálása folyamatos iteratív folyamat, amely monitoring és finomhangolás kombinációját igényli."

Monitoring és megfigyelhetőség

A monitoring kritikus komponens minden stream processing rendszerben. A throughput, latency és error rate metrikák folyamatos nyomon követése lehetővé teszi a problémák korai felismerését. A lag monitoring különösen fontos, mivel jelzi, ha a feldolgozás lemarad az adatbeviteltől.

A distributed tracing segít megérteni az események útját a komplex feldolgozási pipeline-okon keresztül. Az OpenTracing vagy Jaeger eszközök használata átláthatóságot biztosít a rendszer működésébe.

A alerting rendszerek automatikus értesítéseket küldenek, ha a metrikák kritikus küszöbértékeket lépnek át. A dashboards vizuális áttekintést nyújtanak a rendszer állapotáról és teljesítményéről.

A log aggregation központosított naplózást tesz lehetővé, ami elengedhetetlen a hibakeresés és a rendszer viselkedésének megértése szempontjából. Az ELK stack (Elasticsearch, Logstash, Kibana) népszerű választás erre a célra.

Biztonsági megfontolások

A stream processing rendszerek biztonsága több szinten értelmezhető. A transport layer security (TLS) titkosítja az adatátvitelt a komponensek között. A authentication és authorization mechanizmusok biztosítják, hogy csak jogosult felhasználók és alkalmazások férjenek hozzá az adatokhoz.

A data masking és tokenization technikák lehetővé teszik érzékeny adatok védelmét a feldolgozás során. Ez különösen fontos GDPR és más adatvédelmi szabályozások betartása szempontjából.

A audit logging nyomon követi, ki, mikor és milyen műveleteket végzett az adatokon. Ez megfelelőségi követelmények teljesítéséhez és biztonsági incidensek kivizsgálásához szükséges.

"A stream processing rendszerek biztonsága nem utólagos kiegészítés, hanem a tervezés kezdetétől fogva beépítendő követelmény."

Gyakorlati implementációs minták

A microservice architecture jól illeszkedik a stream processing paradigmához. Minden szolgáltatás saját eseményfolyamokat kezelhet, és event-driven communication révén kommunikálhat más szolgáltatásokkal. Ez laza csatolást és jobb skálázhatóságot eredményez.

A CQRS (Command Query Responsibility Segregation) minta elkülöníti az írási és olvasási műveleteket. A parancsok eseményeket generálnak, amelyek stream processing révén frissítik a lekérdezési modelleket. Ez optimalizált teljesítményt biztosít mindkét irányban.

A saga pattern hosszú futású üzleti tranzakciók kezelésére szolgál elosztott környezetben. Az események sorozata vezérli a saga lépéseit, és kompenzáló műveletek biztosítják a konzisztenciát hiba esetén.

Az outbox pattern megoldást nyújt az adatbázis tranzakciók és eseményközzététel atomi végrehajtására. Az események először egy outbox táblába kerülnek, majd külön folyamat publikálja őket a stream processing rendszerbe.

Eszközválasztási kritériumok

A megfelelő stream processing eszköz kiválasztása több tényező mérlegelését igényli. A throughput requirements meghatározzák, milyen mennyiségű adatot kell másodpercenként feldolgozni. Az latency requirements pedig azt, milyen gyorsan kell válaszolni az eseményekre.

A complexity of processing logic befolyásolja, milyen programozási modell szükséges. Egyszerű szűrések és aggregációk esetén SQL-alapú megoldások is elegendőek lehetnek, míg komplex üzleti logika programozási API-kat igényel.

Az operational complexity fontos szempont a hosszú távú karbantarthatóság szempontjából. A felhőalapú managed szolgáltatások csökkentik az operációs terhelést, de kevesebb kontrollt biztosítanak.

A ecosystem integration meghatározza, milyen könnyen integrálható az eszköz a meglévő infrastruktúrával. A connector availability és third-party tool support jelentősen befolyásolhatja a fejlesztési időt.

| Kritérium | Súlyozás | Apache Kafka | Apache Flink | Spark Streaming | Cloud szolgáltatások |

|---|---|---|---|---|---|

| Teljesítmény | Magas | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Egyszerűség | Közepes | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Rugalmasság | Magas | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| Költség | Közepes | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

"A tökéletes stream processing eszköz nem létezik – minden választás kompromisszumokat igényel a különböző követelmények között."

Mik azok az események a stream processing kontextusában?

Az események olyan adatstruktúrák, amelyek egy konkrét időpontban bekövetkezett változást vagy cselekvést reprezentálnak. Tartalmaznak egy időbélyeget, eseménytípust és kapcsolódó adatokat. Például egy webes vásárlás, szenzor mérés vagy felhasználói kattintás.

Mi a különbség a stream és batch feldolgozás között?

A stream feldolgozás folyamatosan, eseményenként dolgozza fel az adatokat, amint azok érkeznek. A batch feldolgozás nagyobb adatcsomagokat gyűjt össze és időszakosan dolgozza fel őket. A stream processing alacsonyabb késleltetést biztosít, míg a batch processing hatékonyabb nagy adatmennyiségek esetén.

Hogyan biztosítható az exactly-once feldolgozás?

Az exactly-once feldolgozás checkpoint mechanizmusokkal, idempotent operációkkal és tranzakcionális közzététellel biztosítható. A rendszernek képesnek kell lennie az állapot visszaállítására hiba esetén és a duplikált üzenetek felismerésére.

Mikor érdemes Lambda architektúrát használni?

A Lambda architektúra akkor hasznos, ha egyszerre van szükség gyors válaszidőre és hosszú távú pontosságra. Különösen előnyös nagy volumenű adatok esetén, ahol a batch réteg pontosabb eredményeket tud produkálni, mint a speed réteg.

Hogyan kezelhető a késleltetett események problémája?

A késleltetett események kezelésére watermark mechanizmusokat és allowed lateness beállításokat használhatunk. Az event-time processing lehetővé teszi az események eredeti időbélyege szerinti feldolgozást, függetlenül az érkezési időtől.

Milyen monitoring metrikák a legfontosabbak?

A legkritikusabb metrikák a throughput (események/másodperc), latency (feldolgozási idő), lag (feldolgozási lemaradás) és error rate (hibaarány). Ezek folyamatos nyomon követése biztosítja a rendszer egészséges működését.