A modern digitális világban minden egyes betű, szám és szimbólum, amit a képernyőn látunk, valójában egy komplex informatikai rendszer eredménye. Amikor gépelünk, programozunk vagy egyszerűen csak böngészünk az interneten, folyamatosan karakterekkel dolgozunk anélkül, hogy tudatában lennénk ennek a háttérben zajló folyamatnak.

A karakter fogalma az informatikában messze túlmutat a hagyományos írásjelek egyszerű megjelenítésén. Ez egy alapvető építőelem, amely lehetővé teszi a számítógépek számára, hogy megértsék és feldolgozzák az emberi nyelveket. A karakterkódolás, karakterkészletek és karakterkezelés mind olyan területek, amelyek meghatározzák, hogyan kommunikálunk a digitális eszközökkel.

Ebben az átfogó útmutatóban megismerheted a karakter informatikai jelentését minden szemszögből. Megtudhatod, hogyan működnek a karakterkódolási rendszerek, milyen típusú karakterek léteznek, és hogyan alkalmazhatod ezt a tudást a gyakorlatban. Emellett betekintést nyersz a karakterkezelés jövőbeli trendjéibe és kihívásaiba is.

A karakter alapvető definíciója az informatikában

A számítógépes rendszerekben a karakter egy alapvető adategység, amely egyetlen írott szimbólumot reprezentál. Ez lehet betű, szám, írásjel vagy speciális szimbólum, amelyet a számítógép képes tárolni, feldolgozni és megjeleníteni. Minden karakter mögött egy numerikus kód áll, amely lehetővé teszi a gép számára az azonosítást és kezelést.

Az informatikai karakter nem csupán vizuális megjelenés, hanem adatstruktúra is egyben. A számítógép bináris rendszerben tárolja ezeket az információkat, ahol minden karakter egy egyedi számkóddal rendelkezik. Ez a kódolási rendszer biztosítja, hogy különböző eszközök és szoftverek között konzisztens legyen a karakterek értelmezése.

A karakterek kezelése kritikus fontosságú minden informatikai alkalmazásban. A szövegszerkesztőktől kezdve az adatbázisokon át a weboldalakig minden olyan rendszerben, ahol szöveges információt dolgozunk fel, alapvető szerepet játszanak.

"A karakterkódolás a digitális kommunikáció alapja – nélküle nem létezhetne egységes információcsere a különböző számítógépes rendszerek között."

Karakterkódolási rendszerek és szabványok

ASCII kódolás és korlátai

Az ASCII (American Standard Code for Information Interchange) volt az első széles körben elterjedt karakterkódolási szabvány. Ez a 7 bites rendszer 128 különböző karaktert képes reprezentálni, beleértve az angol ábécé nagybetűit és kisbetűit, számjegyeket, valamint alapvető írásjeleket.

Az ASCII kódolás egyszerűsége egyben a legnagyobb hátránya is volt. A latin karakterkészletre korlátozódott, így nem tudta kezelni a diakritikus jeleket, különböző nyelvek speciális karaktereit vagy más írásrendszereket. Ez komoly akadályt jelentett a nemzetközi kommunikációban és a többnyelvű alkalmazások fejlesztésében.

A bővített ASCII változatok megjelenése részben megoldotta ezeket a problémákat. A 8 bites kódolás már 256 karaktert tudott kezelni, ami lehetővé tette néhány európai nyelv speciális karaktereinek támogatását.

Unicode szabvány és UTF kódolások

A Unicode forradalmasította a karakterkezelést azzal, hogy egyetlen szabványban egyesítette a világ összes írásrendszerét. Ez a szabvány több mint 140 000 karaktert definiál, lefedve a modern és történelmi írásrendszereket, szimbólumokat és emojikat is.

A Unicode implementációja különböző UTF (Unicode Transformation Format) kódolások révén történik. Az UTF-8 a leggyakrabban használt változat, amely kompatibilis az ASCII-val és változó hosszúságú bájtokat használ. Az UTF-16 és UTF-32 kódolások más megközelítést alkalmaznak a karakterek tárolására.

A Unicode szabvány folyamatosan fejlődik, új karaktereket és írásrendszereket ad hozzá. Ez biztosítja, hogy a digitális kommunikáció lépést tartson a kulturális és nyelvi sokszínűséggel.

| Kódolás | Bájtok száma | Karakterek száma | Kompatibilitás |

|---|---|---|---|

| ASCII | 1 | 128 | Alapvető |

| Extended ASCII | 1 | 256 | Korlátozott |

| UTF-8 | 1-4 | 1,112,064 | ASCII kompatibilis |

| UTF-16 | 2-4 | 1,112,064 | Széles körű |

| UTF-32 | 4 | 1,112,064 | Teljes Unicode |

Karaktertípusok és kategóriák

Alfanumerikus karakterek

Az alfanumerikus karakterek alkotják a szöveges tartalom gerincét minden informatikai rendszerben. Ezek közé tartoznak a betűk (A-Z, a-z) és a számjegyek (0-9), amelyek a legtöbb szövegbeviteli és adatfeldolgozási művelet alapját képezik. Az alfanumerikus karakterek kezelése általában a legegyszerűbb, mivel ezek univerzálisan támogatottak minden karakterkódolási rendszerben.

A programozási nyelvek különböző módon kezelik az alfanumerikus karaktereket. Egyes nyelvek megkülönböztetik a nagybetűket és kisbetűket (case-sensitive), míg mások nem. Ez fontos szempont az adatvalidáció és szövegfeldolgozás során.

Az alfanumerikus karakterek validációja gyakori feladat a webfejlesztésben és adatbázis-kezelésben. Reguláris kifejezések segítségével könnyen szűrhetjük és ellenőrizhetjük ezeket a karaktereket.

Speciális karakterek és szimbólumok

A speciális karakterek kategóriája rendkívül széles spektrumot fed le. Ide tartoznak az írásjelek (pont, vessző, kérdőjel), matematikai szimbólumok (+, -, =), valutajelek ($, €, ¥) és számos más speciális jel. Ezek a karakterek gyakran okoznak problémákat a karakterkódolásban, különösen a régebbi rendszerekben.

A webfejlesztésben a speciális karakterek HTML entitásokként való kezelése gyakori gyakorlat. Ez biztosítja a megfelelő megjelenítést és elkerüli a böngészők értelmezési problémáit. Például a < karakter < entitásként reprezentálható.

Az adatbázisokban a speciális karakterek tárolása és lekérdezése különös figyelmet igényel. A megfelelő kollációs beállítások és karakterkészlet-definíciók nélkül adatvesztés vagy hibás megjelenítés fordulhat elő.

"A speciális karakterek helyes kezelése gyakran különbözteti meg a professzionális alkalmazásokat az amatőr fejlesztésektől."

Whitespace karakterek

A whitespace vagy fehér karakterek láthatatlan elemek, amelyek a szöveg formázását és struktúráját határozzák meg. A szóköz, tabulátor, sortörés és egyéb hasonló karakterek mind ebbe a kategóriába tartoznak. Bár nem láthatók, kritikus szerepet játszanak a szöveg olvashatóságában és feldolgozásában.

A programozásban a whitespace karakterek kezelése nyelvspecifikus szabályokat követ. Egyes nyelvek (például Python) szintaktikai jelentőséggel ruházzák fel a behúzást, míg mások figyelmen kívül hagyják. Ez fontos szempont a kód portabilitása és karbantarthatósága szempontjából.

A szövegfeldolgozás során a whitespace karakterek normalizálása gyakori feladat. Ez magában foglalja a többszörös szóközök eltávolítását, sortörések egységesítését és tabulátorok szóközökre való konvertálását.

Karakterkezelés programozási nyelvekben

String adattípusok és műveletek

A string adattípus a legtöbb programozási nyelv alapvető eleme, amely karakterek sorozatát reprezentálja. A különböző nyelvek eltérő módon implementálják a string kezelést, ami befolyásolja a teljesítményt és a memóriahasználatot. Egyes nyelvekben a stringek megváltozhatatlanok (immutable), míg másokban módosíthatók.

A string műveletek közé tartozik a konkatenáció, részstring kinyerése, keresés és csere. Ezek a műveletek alapvető fontosságúak a szövegfeldolgozásban és az adatmanipulációban. A hatékony string kezelés kritikus a nagy mennyiségű szöveges adat feldolgozásánál.

A memóriakezelés szempontjából a string műveletek optimalizálása komoly kihívást jelenthet. A string pool mechanizmusok és lazy evaluation technikák segíthetnek a teljesítmény javításában.

Karakterkódolás konverziók

A különböző karakterkódolások közötti konverzió gyakori feladat a modern alkalmazásokban. Ez különösen fontos, amikor különböző rendszerek között cserélünk adatot, vagy legacy rendszerekkel dolgozunk. A hibás konverzió adatvesztéshez vagy karakterek helytelen megjelenítéséhez vezethet.

A programozási nyelvek általában beépített függvényeket biztosítanak a karakterkódolás konverziókhoz. Azonban ezek használata során figyelemmel kell lenni a támogatott kódolásokra és a konverzió során esetlegesen fellépő hibákra.

A BOM (Byte Order Mark) kezelése szintén fontos szempont UTF kódolások esetében. Ez a speciális karakter segít azonosítani a fájl karakterkódolását, de problémákat okozhat, ha nem megfelelően kezelik.

"A karakterkódolási hibák gyakran csak production környezetben jelentkeznek, amikor már különböző nyelvű felhasználók használják az alkalmazást."

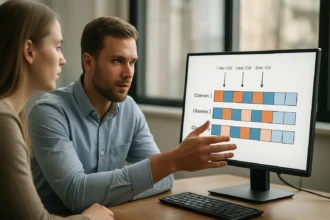

Karakterek szerepe az adatbázisokban

Kollációk és karakterkészletek

Az adatbázis-kezelő rendszerekben a kollációk határozzák meg, hogyan hasonlítja össze és rendezi a rendszer a karaktereket. A kollációs szabályok figyelembe veszik a nyelvi sajátosságokat, mint például az ékezetes betűk kezelését vagy a kis- és nagybetűk megkülönböztetését. A megfelelő kollációs beállítások nélkül a lekérdezések váratlan eredményeket adhatnak.

A karakterkészlet (charset) meghatározza, milyen karaktereket tud tárolni az adatbázis. A UTF-8 karakterkészlet használata általában ajánlott, mivel támogatja a Unicode teljes spektrumát. Azonban a legacy rendszerekben gyakran találkozunk régebbi karakterkészletekkel, amelyek migrációs kihívásokat jelenthetnek.

Az adatbázis szintű karakterkészlet beállítások mellett táblaszintű és oszlopszintű beállítások is lehetségesek. Ez rugalmasságot biztosít, de egyúttal komplexitást is ad a rendszerhez.

Szövegkeresés és indexelés

A szöveges adatok keresése és indexelése komplex feladat, különösen többnyelvű környezetben. A hagyományos B-tree indexek nem mindig optimálisak szöveges keresésre, ezért speciális szöveges indexek (full-text indexek) használata javasolt. Ezek az indexek képesek kezelni a szótövezést, szinonimákat és nyelvi sajátosságokat.

A karakternormalizáció fontos szerepet játszik a keresési funkcionalitásban. Az azonos jelentésű, de eltérő kódolású karakterek (például é vs e + ´) egységes kezelése biztosítja a pontos keresési eredményeket.

A fuzzy matching algoritmusok segítségével a karakterhibákat tartalmazó keresések is eredményre vezethetnek. Ez különösen hasznos felhasználói interfészekben, ahol a gépelési hibák gyakoriak.

| Adatbázis típus | Karakterkészlet támogatás | Kollációs opciók | Teljesítmény |

|---|---|---|---|

| MySQL | UTF8, UTF8MB4, Latin1 | Nyelvi, Binary, CI/CS | Közepes |

| PostgreSQL | UTF8, Latin1, Win1252 | ICU alapú, Locale | Magas |

| Oracle | UTF8, AL32UTF8, WE8MSWIN1252 | Nyelvi, Binary | Magas |

| SQL Server | UTF8, UTF16, Latin1 | Windows kollációk | Közepes |

Webfejlesztés és karakterkódolás

HTML és karakterentitások

A webfejlesztésben a karakterentitások használata elengedhetetlen a speciális karakterek biztonságos megjelenítéséhez. A HTML entitások lehetővé teszik olyan karakterek használatát, amelyek egyébként problémákat okoznának a böngésző értelmezésében. Például a < és > karakterek < és > entitásokként való használata megakadályozza a HTML tag-ek véletlen létrehozását.

A numerikus karakterreferenciák (például € az € szimbólumhoz) alternatív módot biztosítanak a speciális karakterek megjelenítésére. Ez különösen hasznos olyan karakterek esetében, amelyekhez nincs elnevezett entitás definiálva.

A megfelelő DOCTYPE deklaráció és charset meta tag használata biztosítja, hogy a böngésző helyesen értelmezze a dokumentum karakterkódolását. Az UTF-8 kódolás használata általában ajánlott a nemzetközi kompatibilitás érdekében.

HTTP fejlécek és Content-Type

A HTTP protokollban a Content-Type fejléc meghatározza a válasz karakterkódolását. A helyes charset paraméter beállítása kritikus fontosságú a nemzetközi karakterek megfelelő megjelenítéséhez. A hiányzó vagy hibás charset információ böngészőfüggő karakterkódolás-detektáláshoz vezethet, ami inkonzisztens eredményeket okozhat.

A szerver oldali konfigurációban beállított alapértelmezett karakterkódolás felülírható az alkalmazás szintjén. Ez rugalmasságot biztosít, de egyúttal gondos koordinációt igényel a különböző rétegek között.

A REST API-k esetében a JSON formátum UTF-8 kódolást használ alapértelmezetten, ami egyszerűsíti a karakterkezelést. Azonban a kliens-szerver kommunikációban továbbra is figyelemmel kell lenni a karakterkódolási problémákra.

"A webfejlesztésben a karakterkódolási problémák gyakran csak akkor jelentkeznek, amikor az alkalmazást különböző böngészőkben és operációs rendszereken tesztelik."

Karaktervalidáció és biztonság

Input validáció és szűrés

A felhasználói bemenet validálása során a karakterszintű ellenőrzés az első védelmi vonal a biztonsági fenyegetések ellen. A whitelist alapú megközelítés, ahol csak az engedélyezett karaktereket fogadjuk el, általában biztonságosabb, mint a blacklist alapú szűrés. Ez különösen fontos olyan alkalmazásokban, ahol a felhasználói bemenet adatbázisba kerül vagy dinamikus tartalmat generál.

A reguláris kifejezések hatékony eszközt biztosítanak a karakterszintű validációhoz, de használatuk során figyelemmel kell lenni a teljesítményre és a ReDoS (Regular Expression Denial of Service) támadásokra. A komplex reguláris kifejezések exponenciális időkomplexitással rendelkezhetnek bizonyos bemenetekre.

A karakternormalizáció a validáció előtt fontos biztonsági lépés. Az Unicode normalizációs formák (NFC, NFD, NFKC, NFKD) segítségével elkerülhetjük a homoglyph támadásokat és a karakterkódolási bypass kísérleteket.

SQL injekció és karakterkezelés

Az SQL injekció támadások gyakran kihasználják a karakterkódolási problémákat és a hibás escape kezelést. A prepared statement-ek használata és a paraméteres lekérdezések alkalmazása jelentősen csökkenti ezeket a kockázatokat. A karakterszintű escape-elés helyett a teljes lekérdezés struktúrájának védelme a cél.

A multibyte karakterkódolások speciális kihívásokat jelenthetnek az SQL injekció védelem terén. Bizonyos karakterkombinációk a kódolási folyamat során megváltozhatnak, ami bypass lehetőségeket teremt. Az adatbázis és az alkalmazás közötti karakterkódolási konzisztencia biztosítása kritikus fontosságú.

A magic quotes és hasonló automatikus escape mechanizmusok gyakran többet ártanak, mint használnak. Ezek a megoldások nem veszik figyelembe a kontextust és gyakran hibás védelmet biztosítanak.

"A karakterkódolási támadások gyakran kihasználják a különböző rendszerrétegek közötti inkonzisztenciákat."

Karakterek a fájlkezelésben

Fájlnév karakterkorlátozások

A különböző operációs rendszerek eltérő karakterkorlátozásokat alkalmaznak a fájlnevekben. A Windows rendszerek például tiltják bizonyos karakterek (< > : " | ? * ) használatát, míg a Unix-alapú rendszerek liberálisabbak, de a / karakter továbbra is tiltott könyvtár elválasztóként való használata miatt. Ezek a különbségek kompatibilitási problémákat okozhatnak cross-platform alkalmazásokban.

A Unicode karakterek támogatása a fájlnevekben operációs rendszer függő. A modern rendszerek általában támogatják az UTF-8 kódolást, de a legacy rendszerekkel való kompatibilitás érdekében gyakran szükséges a fájlnevek normalizálása vagy transzliterációja.

A fájlnév hosszkorlátozások szintén változnak a fájlrendszerek között. Az NTFS 255 karaktert, az ext4 255 bájtot támogat, ami multibyte karakterek esetében kevesebb karaktert jelenthet. Ezeket a korlátokat figyelembe kell venni a fájlkezelő alkalmazásokban.

Szövegfájlok és BOM kezelés

A Byte Order Mark (BOM) egy speciális karakter szekvencia, amely a szövegfájlok elején található és jelzi a karakterkódolást. Az UTF-8 BOM használata vitatott: míg segíti a karakterkódolás automatikus detektálását, problémákat okozhat olyan rendszerekben, amelyek nem várják el. A web standardok általában nem javasolják az UTF-8 BOM használatát.

A szövegfájlok olvasásakor a BOM automatikus detektálása és eltávolítása gyakori feladat. Azonban figyelemmel kell lenni arra, hogy a BOM eltávolítása ne okozzon problémát olyan alkalmazásokban, amelyek arra támaszkodnak a karakterkódolás meghatározásában.

A line ending karakterek (CRLF, LF, CR) kezelése szintén fontos szempont a cross-platform kompatibilitásban. A Git és más verziókezelő rendszerek automatikus konverziót biztosítanak, de az alkalmazás szintjén is szükség lehet ezek kezelésére.

Nemzetköziesítés és lokalizáció

Többnyelvű alkalmazások karakterkezelése

A nemzetközi alkalmazások fejlesztése során a karakterkezelés komplexitása exponenciálisan nő. Minden támogatott nyelv saját karakterkészlettel, írásirányával és tipográfiai szabályaival rendelkezik. A jobbról balra íródó nyelvek (arab, héber) különleges kihívásokat jelentenek a szöveg megjelenítés és szerkesztés terén.

A font fallback mechanizmusok biztosítják, hogy a nem támogatott karakterek helyett valamilyen alternatív megjelenítés történjen. Ez különösen fontos emoji és speciális szimbólumok esetében, ahol a platform függő megjelenítés normális.

A kulturális különbségek figyelembevétele túlmutat a karakterkészleteken. A számformátumok, dátumformátumok és valutamegjelenítés mind befolyásolják a karakterek használatát és megjelenítését.

Szövegirány és formázás

A bidirectional (bidi) szöveg kezelése komplex algoritmusokat igényel, különösen vegyes irányú szövegek esetében. Az Unicode Bidirectional Algorithm szabványos megoldást biztosít, de implementációja kihívásokat jelent. A HTML-ben a dir attribútum és a CSS direction tulajdonság segíti a megfelelő megjelenítést.

A szöveg tördelése és sortörése nyelvfüggő szabályokat követ. A kínai és japán nyelvekben nincsenek szóközök, így a sortörés algoritmusoknak más logikát kell követniük. A Unicode Line Breaking Algorithm iránymutatást ad ezekhez a kérdésekhez.

A tipográfiai finomságok, mint a ligaturák és a kerning, szintén befolyásolják a karakterek megjelenítését. Ezek kezelése általában a renderelő engine feladata, de az alkalmazás szintjén is lehet rájuk hatásunk.

"A nemzetközi alkalmazások karakterkezelése nem csak technikai, hanem kulturális kihívás is – minden nyelv saját szabályrendszert hoz magával."

Teljesítmény és optimalizáció

Memóriahatékony karakterkezelés

A karakterek memóriahasználata jelentős tényező lehet nagy mennyiségű szöveges adat feldolgozásakor. Az UTF-32 kódolás fix 4 bájtos karakterenként egyszerű indexelést biztosít, de pazarló lehet olyan szövegek esetében, amelyek főként ASCII karaktereket tartalmaznak. Az UTF-8 változó hosszúságú kódolása memóriahatékonyabb, de komplexebb feldolgozást igényel.

A string interning technika segítségével csökkenthető a memóriahasználat ismétlődő stringek esetében. Ez különösen hatékony lehet konfigurációs fájlok, template rendszerek és más strukturált szöveges adatok feldolgozásánál.

A lazy loading és streaming megközelítések lehetővé teszik nagy szövegfájlok feldolgozását anélkül, hogy a teljes tartalom memóriába kerülne. Ez kritikus fontosságú lehet big data alkalmazásokban és real-time szövegfeldolgozásban.

Cache stratégiák karakterműveletekhez

A karakterkódolási konverziók CPU-igényes műveletek lehetnek, különösen komplex Unicode normalizáció esetében. A konverziós eredmények cache-elése jelentős teljesítményjavulást eredményezhet ismétlődő műveletek esetében. Azonban figyelemmel kell lenni a cache invalidáció stratégiákra és a memóriahasználatra.

A regex pattern compilation költséges művelet, ezért a gyakran használt minták előre lefordítása és cache-elése javasolt. Ez különösen fontos validációs és szövegfeldolgozási alkalmazásokban, ahol ugyanazokat a mintákat gyakran használják.

A font loading és character metrics cache-elése javíthatja a szövegmegjelenítés teljesítményét. Modern böngészők és alkalmazások kifinomult cache stratégiákat alkalmaznak a smooth scrolling és responsive UI biztosításához.

Hibakeresés és diagnosztika

Karakterkódolási problémák azonosítása

A karakterkódolási hibák gyakran rejtőzködő problémák, amelyek csak bizonyos körülmények között jelentkeznek. A mojibake (hibás karaktermegjelenítés) jelenség tipikus jele a karakterkódolási problémáknak. A hexadecimális dump és binary analízis eszközök segíthetnek a tényleges bájtok vizsgálatában.

A browser developer tools Network tab-ja információt ad a HTTP fejlécekben specifikált karakterkódolásról. Az eltérés a deklarált és a tényleges kódolás között gyakori hibaforrás. A Content-Type header és a HTML meta charset összehasonlítása gyakran felfedi a problémát.

A log fájlok elemzése során figyelemmel kell lenni a karakterkódolási problémákra. A strukturált logging és a megfelelő encoding beállítások segíthetnek a hibakeresésben. Az ELK stack és hasonló log analízis eszközök támogatják a Unicode karaktereket.

Tesztelési stratégiák

A karakterkezelés tesztelése magában foglalja a határesetek vizsgálatát, mint például üres stringek, nagyon hosszú szövegek, és különleges Unicode karakterek. A property-based testing megközelítés hasznos lehet a karakterkezelési logika robusztusságának ellenőrzésére.

A nemzetközi tesztelés során különböző nyelvi környezetekben kell ellenőrizni az alkalmazást. A pseudo-localization technika segítségével a fejlesztési fázisban felderíthetők a nemzetköziesítési problémák. Ez magában foglalja a szövegek mesterséges megnyújtását és speciális karakterekkel való helyettesítését.

A teljesítménytesztelés során figyelemmel kell lenni a karakterkódolási műveletek hatására. A profiling eszközök segíthetnek azonosítani a szűk keresztmetszeteket a szövegfeldolgozási pipeline-ban.

Jövőbeli trendek és fejlesztések

Emoji és multimédia karakterek

Az emoji karakterek exponenciális növekedése új kihívásokat hoz a karakterkezelésben. Az Unicode Consortium rendszeresen ad hozzá új emoji karaktereket, amelyek gyakran komplex rendering algoritmusokat igényelnek. A skin tone modifierek és a zero-width joiner (ZWJ) szekvenciák lehetővé teszik az emoji testreszabását, de komplexitást adnak a feldolgozáshoz.

A multimédia karakterek, mint például a színes emoji és a vectorial glyphek, túlmutatnak a hagyományos karakterkezelésen. Ezek gyakran SVG vagy bitmap formátumban tárolódnak és speciális renderelési pipeline-t igényelnek. A web fontok és az OpenType funkciók új lehetőségeket biztosítanak a gazdag tipográfiai megjelenítéshez.

A voice és gesture-based interface-ek megjelenése új dimenziókat ad a karakterkezelésnek. A speech-to-text és text-to-speech rendszerek karakterszintű pontosságot igényelnek a megfelelő működéshez.

Mesterséges intelligencia és karakterfelismerés

A machine learning algoritmusok forradalmasítják a karakterfelismerést és -feldolgozást. Az OCR (Optical Character Recognition) technológiák egyre pontosabbá válnak, különösen a deep learning modellek alkalmazásával. Ez új lehetőségeket nyit a dokumentum digitalizálásban és az accessibility területén.

A natural language processing (NLP) modellek karakterszintű elemzést alkalmaznak a szöveg megértéséhez. A transformer architektúrák, mint a BERT és GPT, tokenizációs stratégiákat használnak, amelyek befolyásolják a karakterkezelési követelményeket.

A real-time translation és a cross-lingual search funkciók új kihívásokat jelentenek a karakterkódolás terén. Ezek a rendszerek képesnek kell lenniük a különböző írásrendszerek közötti váltásra és a kulturális kontextus megőrzésére.

"A jövő karakterkezelési kihívásai nem csak technikai természetűek lesznek, hanem kulturális és kognitív szempontokat is figyelembe kell venniük."

Milyen a különbség az ASCII és UTF-8 kódolás között?

Az ASCII 7 bites kódolás, amely 128 karaktert támogat, főként angol nyelvű tartalmakhoz. Az UTF-8 változó hosszúságú kódolás (1-4 bájt), amely több mint 1 millió karaktert támogat és kompatibilis az ASCII-val.

Hogyan oldhatom meg a karakterkódolási problémákat weboldalamon?

Győződj meg róla, hogy a HTML meta charset tag UTF-8-ra van állítva, a szerver Content-Type header-je megegyezik ezzel, és a fájlok valóban UTF-8 kódolásban vannak mentve. Használj HTML entitásokat speciális karakterekhez.

Miért jelennek meg kérdőjelek vagy furcsa karakterek a szövegben?

Ez általában karakterkódolási eltérés miatt történik. A megjelenítő rendszer más kódolást feltételez, mint amiben a szöveg tárolva van. Ellenőrizd a fájl kódolását és a megjelenítési beállításokat.

Hogyan kezeljem a speciális karaktereket adatbázisban?

Használj UTF-8 vagy UTF8MB4 karakterkészletet MySQL esetében, állítsd be a megfelelő kollációt, és győződj meg róla, hogy az alkalmazás és adatbázis kapcsolat is UTF-8 kódolást használ.

Mit jelent a BOM és mikor használjam?

A Byte Order Mark egy speciális karakter a fájl elején, amely jelzi a karakterkódolást. UTF-8 esetében általában nem szükséges és problémákat okozhat webfejlesztésben, de hasznos lehet desktop alkalmazásokban.

Hogyan validáljam a felhasználói bevitelt karakterszinten?

Használj whitelist alapú megközelítést reguláris kifejezésekkel, normalizáld a Unicode karaktereket, és alkalmazz kontextus-specifikus validációt. Kerüld a blacklist alapú szűrést biztonsági okokból.