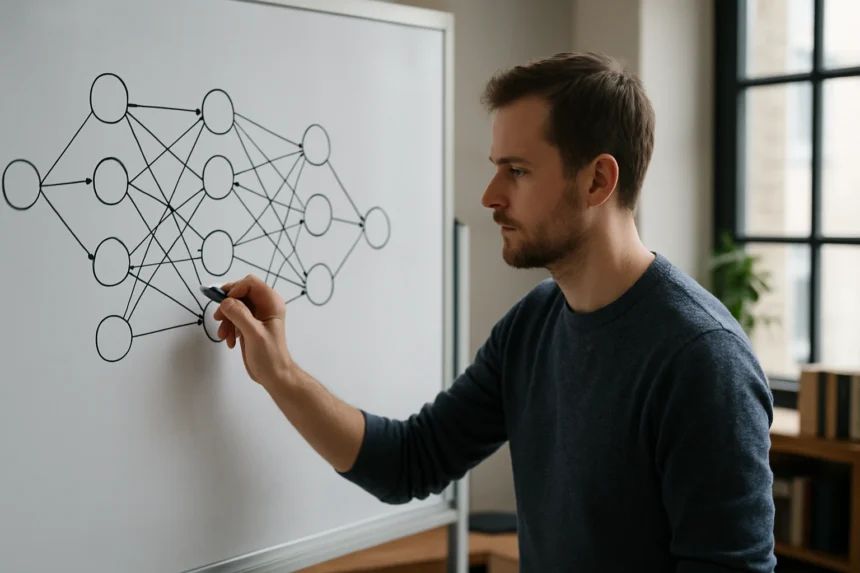

A mesterséges intelligencia világában folyamatosan keresünk olyan megoldásokat, amelyek hatékonyabban tudják modellezni a valóság összetettségét. A hagyományos neurális hálózatok, bár rendkívül sikeresek, gyakran fekete dobozként működnek, ahol nehéz megérteni a döntéshozatal folyamatát. Éppen ezért izgalmas fejlemény, amikor új architektúrák jelennek meg, amelyek más megközelítést kínálnak.

A Kolmogorov-Arnold hálózat (KAN) egy forradalmi neurális hálózati architektúra, amely a hagyományos többrétegű perceptron (MLP) alternatívájaként szolgál. Ez az innovatív megközelítés a Kolmogorov-Arnold reprezentációs tételen alapul, amely szerint bármely többváltozós folytonos függvény felírható egyváltozós függvények összegeként és kompozíciójaként. A KAN hálózatok egyedi tulajdonsága, hogy az aktivációs függvényeket nem a neuronokban, hanem az élek mentén helyezik el, ami fundamentálisan más működési logikát eredményez.

Az alábbiakban részletesen megvizsgáljuk ezt az új paradigmát, feltárjuk működési mechanizmusait, előnyeit és gyakorlati alkalmazási lehetőségeit. Megismerkedünk a matematikai alapokkal, összehasonlítjuk a hagyományos módszerekkel, és konkrét példákon keresztül mutatjuk be, hogyan forradalmasíthatja ez a technológia a gépi tanulás területét.

A Kolmogorov-Arnold reprezentációs tétel alapjai

A matematikai háttér megértése kulcsfontosságú a KAN hálózatok működésének megragadásához. Andrey Kolmogorov és Vladimir Arnold 1957-ben bizonyította be azt a tételt, amely szerint minden n-változós folytonos függvény reprezentálható (2n+1) egyváltozós folytonos függvény segítségével.

Formálisan ezt a következőképpen írhatjuk fel: f(x₁, x₂, …, xₙ) = Σᵢ₌₀²ⁿ gᵢ(Σⱼ₌₁ⁿ φᵢⱼ(xⱼ)), ahol a φᵢⱼ függvények univerzálisak és nem függenek az f függvénytől. Ez az eredmény megdöntötte Hilbert 13. problémájának egy részét, amely azt feltételezte, hogy bizonyos függvények nem reprezentálhatók alacsonyabb dimenziós függvények kompozíciójaként.

A tétel gyakorlati jelentősége abban rejlik, hogy elméleti keretet biztosít a komplex többdimenziós problémák egyszerűbb, egydimenziós részproblémákra bontásához. Ez különösen fontos a neurális hálózatok kontextusában, ahol a cél mindig a bemeneti adatok és a kimenetek közötti összetett kapcsolatok modellezése.

A tétel modern interpretációja

A Kolmogorov-Arnold tétel eredeti formájában nehezen alkalmazható volt a gyakorlatban, mivel a φᵢⱼ függvények nem simák és fraktál természetűek. A modern KAN implementációk azonban simább, tanulható függvényekkel helyettesítik ezeket, amelyek jobban illeszkednek a neurális hálózatok optimalizációs követelményeihez.

Az új megközelítés lényege, hogy a hagyományos neurális hálózatok lineáris transzformációit és rögzített aktivációs függvényeit felváltják tanulható, spline-alapú függvényekkel. Ez lehetővé teszi, hogy a hálózat ne csak a súlyokat, hanem magát az aktivációs függvények formáját is megtanulja.

A gyakorlatban ez azt jelenti, hogy minden él a hálózatban egy egyedi, paraméterezett függvényt tartalmaz, amely a tanulási folyamat során alakul ki. Ez fundamentálisan különbözik a hagyományos megközelítéstől, ahol minden neuron ugyanazt az aktivációs függvényt (pl. ReLU, sigmoid) használja.

KAN vs hagyományos neurális hálózatok

A különbségek megértéséhez érdemes részletesen összehasonlítani a két architektúrát. A hagyományos többrétegű perceptronok rögzített aktivációs függvényekkel és tanulható súlyokkal működnek, míg a KAN hálózatok éppen fordítva: tanulható aktivációs függvényekkel és minimális paraméterszámmal.

| Tulajdonság | Hagyományos MLP | Kolmogorov-Arnold hálózat |

|---|---|---|

| Aktivációs függvény | Rögzített (ReLU, sigmoid) | Tanulható (spline-alapú) |

| Súlyok | Tanulható mátrix | Minimális vagy nincs |

| Interpretálhatóság | Alacsony | Magas |

| Paraméterszám | Nagy | Kisebb |

| Approximációs képesség | Univerzális | Univerzális |

A KAN architektúra három fő előnnyel rendelkezik a hagyományos hálózatokkal szemben. Először is, jobb interpretálhatóságot biztosít, mivel az élek mentén elhelyezett függvények közvetlenül vizualizálhatók és elemezhetők. Másodszor, gyakran kevesebb paraméterrel éri el ugyanazt a teljesítményt, ami hatékonyabb tanulást eredményez.

Harmadszor, a KAN hálózatok természetesen alkalmasak szimbolikus regresszióra, vagyis képesek matematikai formulák felfedezésére az adatokban. Ez különösen értékes a tudományos alkalmazásokban, ahol nem csak a predikció pontossága, hanem az alapul szolgáló törvényszerűségek megértése is fontos.

Működési mechanizmus különbségei

A hagyományos neurális hálózatokban az információ feldolgozása rétegről rétegre történik, ahol minden neuron egy lineáris kombinációt követ egy nemlineáris aktivációval. A KAN hálózatokban viszont minden kapcsolat egyedi függvényt tartalmaz, amely lokálisan adaptálódik az adatokhoz.

Ez a különbség lehetővé teszi, hogy a KAN hálózatok jobban kihasználják az adatok struktúráját. Míg egy MLP minden bemeneti kombinációra ugyanazt az aktivációs függvényt alkalmazza, addig a KAN minden egyes kapcsolatra specifikus transzformációt tanul meg.

A tanulási folyamat is eltérő: a KAN hálózatok spline-alapú interpolációt használnak, amely lehetővé teszi a sima, folytonos függvények tanulását. Ez különösen hasznos olyan alkalmazásokban, ahol a kimenetek simák és differenciálhatók kell, hogy legyenek.

Spline-alapú aktivációs függvények

A KAN hálózatok szívében a B-spline alapú aktivációs függvények állnak. Ezek a függvények rugalmas, tanulható görbéket biztosítanak, amelyek képesek alkalmazkodni az adatok helyi jellemzőihez. A spline-ok matematikai tulajdonságai ideálissá teszik őket neurális hálózati alkalmazásokra.

Egy B-spline függvény szakaszonként polinomiális, folytonos és simán differenciálható. Az i-edik B-spline alapfüggvény Bᵢ,ₖ(x) k-ad fokú polinomokból áll össze, amelyek egy adott csomóponthalmaz felett vannak definiálva. A KAN implementációkban általában kubikus spline-okat használnak (k=3), amelyek jó egyensúlyt biztosítanak a rugalmasság és a számítási hatékonyság között.

A spline-alapú megközelítés előnyei közé tartozik a lokális kontroll lehetősége, ami azt jelenti, hogy egy régióban történő változtatás nem befolyásolja a függvény távoli részeit. Ez stabilitást biztosít a tanulási folyamatban és megakadályozza a katasztrofális elfelejtést.

Implementációs részletek

A gyakorlatban minden él egy spline függvényt tartalmaz, amely paraméterezett kontrollpontokkal rendelkezik. Ezek a kontrollpontok a tanulás során optimalizálódnak, lehetővé téve a függvény alakjának finomhangolását. A grid-based megközelítés biztosítja, hogy a spline-ok hatékonyan kiértékelhetők legyenek még nagy hálózatok esetén is.

Az inicializálás kritikus szerepet játszik a KAN hálózatok teljesítményében. A spline függvényeket általában egyszerű függvényekkel (például lineáris vagy alacsony fokú polinomok) inicializálják, majd a tanulás során fokozatosan komplexebbé válnak. Ez a progresszív komplexitás elve segít elkerülni a lokális minimumokat.

A regularizáció szintén fontos szempont, mivel a spline függvények hajlamosak lehetnek a túltanulásra. Különböző regularizációs technikákat alkalmaznak, beleértve a simítási büntetéseket és a sparsity megszorításokat, amelyek egyszerűbb és általánosíthatóbb modelleket eredményeznek.

Interpretálhatóság és vizualizáció

Az egyik legfontosabb előnye a KAN hálózatoknak a kiváló interpretálhatóság. Mivel minden él egy explicit függvényt tartalmaz, ezek közvetlenül vizualizálhatók és elemezhetők. Ez lehetővé teszi a felhasználók számára, hogy megértsék, hogyan dolgozza fel a hálózat az információt.

A vizualizáció többféle formát ölthet. Az élek mentén található függvények egyenként ábrázolhatók, megmutatva, hogyan transzformálják az egyes bemeneteket. Ezenkívül a teljes hálózat struktúrája grafikusan megjeleníthető, ahol az élek vastagsága vagy színe jelzi a függvények fontosságát vagy aktivitását.

A szimbolikus interpretáció további lehetőségeket kínál. A megtanult spline függvények gyakran közelíthetők egyszerű matematikai kifejezésekkel, mint például polinomok, exponenciális függvények vagy trigonometrikus függvények. Ez lehetővé teszi a hálózat működésének matematikai formulákként történő kifejezését.

Gyakorlati alkalmazások az interpretálhatóságban

Tudományos alkalmazásokban ez az interpretálhatóság felbecsülhetetlen értékű. A fizikában például egy KAN hálózat képes lehet felfedezni az adatokban rejlő fizikai törvényszerűségeket, amelyeket aztán explicit matematikai formában lehet kifejezni. Ez túlmutat a hagyományos gépi tanulás prediktív képességein.

Az orvostudományban a KAN hálózatok segíthetnek megérteni a betegségek és tünetek közötti összetett kapcsolatokat. A vizualizálható függvények lehetővé teszik az orvosok számára, hogy nyomon kövessék a döntéshozatal folyamatát és megbízzanak a modell ajánlásaiban.

A pénzügyi szektorban szintén nagy jelentőséggel bír az interpretálhatóság, ahol a regulációs megfelelés gyakran megköveteli a döntések magyarázhatóságát. A KAN hálózatok átlátható működése segíthet teljesíteni ezeket a követelményeket.

Tanulási algoritmusok és optimalizáció

A KAN hálózatok tanítása speciális optimalizációs technikákat igényel a spline paraméterek hatékony frissítéséhez. A hagyományos backpropagation algoritmus adaptálható, de figyelembe kell venni a spline függvények sajátosságait. A gradiens számítása összetettebb, mivel nemcsak a kontrollpontok értékeit, hanem azok pozícióit is optimalizálni kell.

Az egyik kulcsfontosságú kihívás a grid adaptáció, amely során a spline-ok csomópontjainak elhelyezkedése dinamikusan változik a tanulás során. Ez lehetővé teszi a hálózat számára, hogy nagyobb felbontást alkalmazzon az adatok fontos régióiban, miközben kevesebb paramétert használ a kevésbé releváns területeken.

A regularizáció stratégiái is eltérnek a hagyományos hálózatoktól. A smoothness regularization büntetést alkalmaz a túl görbe függvényekre, míg a sparsity regularization arra ösztönzi a hálózatot, hogy egyszerűbb függvényeket tanuljon meg. Ezek a technikák segítenek elkerülni a túltanulást és javítják az általánosítási képességet.

| Optimalizációs kihívás | Megoldási stratégia | Hatás |

|---|---|---|

| Grid adaptáció | Dinamikus csomópont elhelyezés | Jobb felbontás fontos régiókban |

| Smoothness | L2 regularizáció a deriváltakra | Simább függvények |

| Sparsity | L1 büntetés | Egyszerűbb modellek |

| Gradiens instabilitás | Adaptív learning rate | Stabil konvergencia |

Hiperparaméter beállítás

A KAN hálózatok számos hiperparamétert tartalmaznak, amelyek gondos hangolást igényelnek. A spline-ok foka, a grid mérete, a regularizációs súlyok és a tanulási ráta mind kritikus szerepet játszanak a teljesítményben. Az automatikus hiperparaméter optimalizáció különösen hasznos lehet ezekben az esetekben.

A progressive training stratégia gyakran alkalmazott technika, ahol a hálózatot először egyszerű függvényekkel tanítják, majd fokozatosan növelik a komplexitást. Ez segít elkerülni a lokális minimumokat és stabilabb konvergenciát eredményez.

A batch size és a tanulási ütemezés is fontos szerepet játszik. A KAN hálózatok gyakran jobb teljesítményt nyújtanak kisebb batch méretekkel, amely lehetővé teszi a finomabb adaptációt az adatok lokális struktúrájához.

Alkalmazási területek és esettanulmányok

A KAN hálózatok sokoldalú alkalmazhatósága számos területen nyilvánul meg. A tudományos számításokban különösen értékesek, ahol nemcsak a predikció pontossága, hanem az alapul szolgáló törvényszerűségek megértése is fontos. A fizikai szimulációkban például képesek felfedezni az adatokban rejlő parciális differenciálegyenleteket.

A szimbolikus regresszió területén a KAN hálózatok kiemelkedő teljesítményt nyújtanak. Képesek komplex matematikai függvényeket tanulni és azokat interpretálható formában kifejezni. Ez különösen hasznos olyan területeken, mint a biológia, ahol a génexpresszió és a fenotípus közötti kapcsolatok feltárása kritikus fontosságú.

Az idősor-előrejelzésben a KAN hálózatok természetes módon kezelik a nemlineáris dinamikát. A spline-alapú függvények rugalmasan alkalmazkodnak a különböző időskálákhoz és mintázatokhoz, ami jobb előrejelzési pontosságot eredményez a hagyományos módszerekkel szemben.

Konkrét alkalmazási példák

A klimatológiában KAN hálózatokat használnak a klímaváltozás modellezésére, ahol képesek azonosítani a különböző környezeti változók közötti összetett visszacsatolásokat. Az interpretálhatóság lehetővé teszi a tudósok számára, hogy megértsék a modell által feltárt kapcsolatokat és azokat fizikai intuícióval validálják.

Az anyagtudomány területén a KAN hálózatok segítenek új anyagok tulajdonságainak előrejelzésében. A molekuláris struktúra és a makroszkopikus tulajdonságok közötti kapcsolatok feltárása révén gyorsíthatják az anyagfejlesztési folyamatokat.

A pénzügyi modellezésben a KAN hálózatok képesek kezelni a piaci volatilitás nemlineáris természetét, miközben interpretálható betekintést nyújtanak a kockázati tényezőkbe. Ez különösen értékes a portfólió optimalizáció és a kockázatkezelés területén.

"A KAN hálózatok forradalmasíthatják a tudományos felfedezést azáltal, hogy nemcsak előrejelzéseket készítenek, hanem feltárják az adatok mögötti matematikai struktúrákat is."

"Az interpretálhatóság nem luxus, hanem szükségszerűség a kritikus alkalmazásokban, ahol megérteni kell a döntéshozatal folyamatát."

"A spline-alapú aktivációs függvények természetes rugalmasságot biztosítanak, amely lehetővé teszi a komplex függvények hatékony approximációját."

"A KAN architektúra bizonyítja, hogy a neurális hálózatok nem csak fekete dobozok lehetnek, hanem átlátható, értelmezhető rendszerek is."

"A Kolmogorov-Arnold tétel gyakorlati alkalmazása megnyitja az utat a matematikai felfedezések automatizálása felé."

Implementációs kihívások és megoldások

A KAN hálózatok gyakorlati megvalósítása számos technikai kihívást vet fel. A spline függvények kiértékelése számításilag drágább lehet, mint a hagyományos aktivációs függvények, különösen nagy hálózatok esetén. Ez optimalizált implementációkat és hardver-specifikus gyorsításokat igényel.

A memóriahasználat szintén kritikus szempont, mivel minden él külön spline paramétereket tárol. Ez jelentősen megnövelheti a memóriaigényt a hagyományos hálózatokhoz képest. Hatékony memóriakezelési stratégiák és paraméter-megosztási technikák alkalmazása szükséges a skálázhatóság biztosításához.

A numerikus stabilitás másik fontos kérdés. A spline interpoláció érzékeny lehet a kontrollpontok elhelyezkedésére, és instabilitást okozhat szélsőséges értékek esetén. Adaptív normalizálási technikák és robusztus interpolációs módszerek alkalmazása segíthet ezek kezelésében.

Szoftver és hardver optimalizáció

Modern implementációk GPU-gyorsítást használnak a spline kiértékelések párhuzamosításához. A CUDA és OpenCL alapú implementációk jelentős sebességnövekedést érhetnek el, különösen nagy batch méretekkel dolgozva. A tensor műveletek optimalizálása kulcsfontosságú a gyakorlati alkalmazhatósághoz.

A kvantizáció és a pruning technikák adaptálása a KAN hálózatokra új kutatási irányokat nyit meg. A spline paraméterek kvantizálása csökkentheti a memóriaigényt, míg a kevésbé fontos élek eltávolítása egyszerűsítheti a modellt anélkül, hogy jelentősen befolyásolná a teljesítményt.

Az automatikus differenciálás keretrendszerek, mint a PyTorch és TensorFlow, támogatást nyújtanak a KAN implementációkhoz. Azonban speciális optimalizációk szükségesek a spline gradiens számításához, amely eltér a hagyományos műveletek gradienseitől.

Összehasonlítás más modern architektúrákkal

A KAN hálózatok helyének megértéséhez érdemes összehasonlítani őket más modern neurális hálózati architektúrákkal. A Transformer modellekkel való összehasonlításban a KAN hálózatok előnye a kisebb paraméterszám és a jobb interpretálhatóság, míg hátrányuk a szekvenciális adatok kezelésében való korlátozott tapasztalat.

A konvolúciós neurális hálózatokkal (CNN) szemben a KAN hálózatok nem rendelkeznek beépített térbeli invarianciával, de rugalmasabb függvény-approximációs képességekkel bírnak. A hibrid megközelítések, ahol a KAN rétegeket CNN architektúrákba integrálják, ígéretes eredményeket mutatnak.

A Graph Neural Networks (GNN) területén a KAN hálózatok természetes módon alkalmazhatók, mivel az élek mentén elhelyezett függvények jól illeszkednek a gráf struktúrákhoz. Ez új lehetőségeket nyit meg a molekuláris modellezés és a társadalmi hálózatok elemzése területén.

Hibrid architektúrák

A KAN-CNN hibridek kombinálják a konvolúciós rétegek térbeli feldolgozó képességét a KAN rétegek rugalmas függvény-approximációjával. Ez különösen hatékony lehet képfeldolgozási feladatokban, ahol a térbeli jellemzők kinyerése után komplex nemlineáris transzformációkra van szükség.

A KAN-Transformer architektúrák a figyelemmechanizmus előnyeit ötvözik a KAN hálózatok interpretálhatóságával. Ez lehetővé teheti a természetes nyelvfeldolgozási feladatok jobb megértését és magyarázhatóságát.

A Residual KAN hálózatok a skip kapcsolatok előnyeit hozzák a KAN architektúrába, lehetővé téve mélyebb hálózatok tanítását gradiens eltűnési problémák nélkül. Ez kibővíti a KAN hálózatok alkalmazhatóságát összetettebb feladatokra.

Jövőbeli kutatási irányok

A KAN hálózatok fejlesztésének számos ígéretes iránya van. Az automatikus architektúra keresés (NAS) alkalmazása KAN hálózatokra lehetővé teheti optimális topológiák automatikus felfedezését különböző feladatokhoz. Ez jelentősen csökkentheti a manuális tervezés szükségességét.

A meta-learning és few-shot learning területén a KAN hálózatok gyors adaptációs képességei különösen értékesek lehetnek. A spline függvények rugalmassága lehetővé teheti a gyors finomhangolást új feladatokra minimális adattal.

A neuromorphic computing területén a KAN hálózatok biológiai plausibilitása érdekes kutatási lehetőségeket kínál. A spline-alapú aktivációs függvények jobban modellezhetik a valódi neuronok nemlineáris válaszfüggvényeit.

Elméleti fejlesztések

Az approximációs elmélet további fejlesztése segíthet megérteni a KAN hálózatok elméleti korlátait és lehetőségeit. Új tételek bizonyítása a konvergencia sebességről és az approximációs hibákról javíthatja a gyakorlati alkalmazásokat.

A generalizációs képesség elméleti elemzése kritikus fontosságú a KAN hálózatok szélesebb körű elfogadásához. A VC-dimenzió és a Rademacher komplexitás tanulmányozása betekintést nyújthat a túltanulás elkerülésébe.

A kvantum-inspirált KAN hálózatok kutatása új paradigmát nyithat meg, ahol a kvantummechanikai szuperpozíció és interferencia elvei inspirálják a hálózati architektúrát. Ez különösen érdekes lehet a kvantum-gépi tanulás területén.

Mik a KAN hálózatok fő előnyei a hagyományos neurális hálózatokkal szemben?

A KAN hálózatok három fő előnnyel rendelkeznek: jobb interpretálhatóság az élek mentén elhelyezett vizualizálható függvények miatt, gyakran kisebb paraméterszám mellett ugyanolyan vagy jobb teljesítmény, valamint természetes alkalmasság a szimbolikus regresszióra és matematikai formulák felfedezésére.

Hogyan működnek a spline-alapú aktivációs függvények?

A spline-alapú aktivációs függvények B-spline interpolációt használnak tanulható kontrollpontokkal. Ezek szakaszonként polinomiális, folytonos és simán differenciálható függvények, amelyek rugalmasan alkalmazkodnak az adatok helyi jellemzőihez a tanulási folyamat során.

Milyen alkalmazási területeken hasznosak leginkább a KAN hálózatok?

A KAN hálózatok különösen értékesek tudományos alkalmazásokban (fizika, biológia, klimatológia), ahol az interpretálhatóság kritikus, szimbolikus regresszióban matematikai törvényszerűségek felfedezésére, valamint olyan területeken, ahol regulációs megfelelés megköveteli a döntések magyarázhatóságát.

Milyen kihívások merülnek fel a KAN hálózatok implementációja során?

A fő kihívások közé tartozik a nagyobb számítási komplexitás a spline kiértékelés miatt, megnövekedett memóriaigény az élenkénti paraméterek tárolásához, numerikus stabilitási problémák szélsőséges értékeknél, valamint speciális optimalizációs technikák szükségessége.

Hogyan viszonyulnak a KAN hálózatok más modern architektúrákhoz?

A KAN hálózatok kisebbek és interpretálhatóbbak a Transformer modellekhez képest, rugalmasabb függvény-approximációval rendelkeznek a CNN-ekhez képest, és természetesen alkalmazhatók Graph Neural Networks környezetben. Hibrid megközelítések kombinálják ezek előnyeit.

Milyen jövőbeli fejlesztések várhatók a KAN hálózatok területén?

A jövőbeli kutatások irányai közé tartozik az automatikus architektúra keresés alkalmazása, meta-learning és few-shot learning fejlesztések, neuromorphic computing alkalmazások, valamint az approximációs elmélet és generalizációs képesség elméleti elemzése.