A mesterséges intelligencia világában kevés olyan áttörés történt, amely annyira radikálisan megváltoztatta volna a számítógépek nyelvi képességeit, mint a maszkolt nyelvi modellek megjelenése. Ezek a rendszerek nem csupán technológiai újítások, hanem olyan eszközök, amelyek fundamentálisan átírták, hogyan gondolkodunk a gépek és az emberi nyelv kapcsolatáról.

A maszkolt nyelvi modellek lényegében olyan neurális hálózatok, amelyek a szöveg kontextusából tanulnak meg szavakat és jelentéseket megjósolni. Ugyanakkor ez a definíció csak a felszínt karcolja meg – valójában sokkal komplexebb folyamatokról beszélünk, amelyek magukban foglalják a szintaktikai, szemantikai és pragmatikai nyelvi szintek együttes feldolgozását. Különböző megközelítések léteznek ezen modellek értelmezésére és alkalmazására.

Az alábbi elemzés során mélyrehatóan megvizsgáljuk ezeket a forradalmi rendszereket – működési mechanizmusuktól kezdve a gyakorlati alkalmazásokig. Betekintést nyújtunk a technológiai háttérbe, bemutatjuk a legfontosabb modelleket, és feltárjuk azokat a lehetőségeket, amelyeket ezek az eszközök kínálnak a jövő számára.

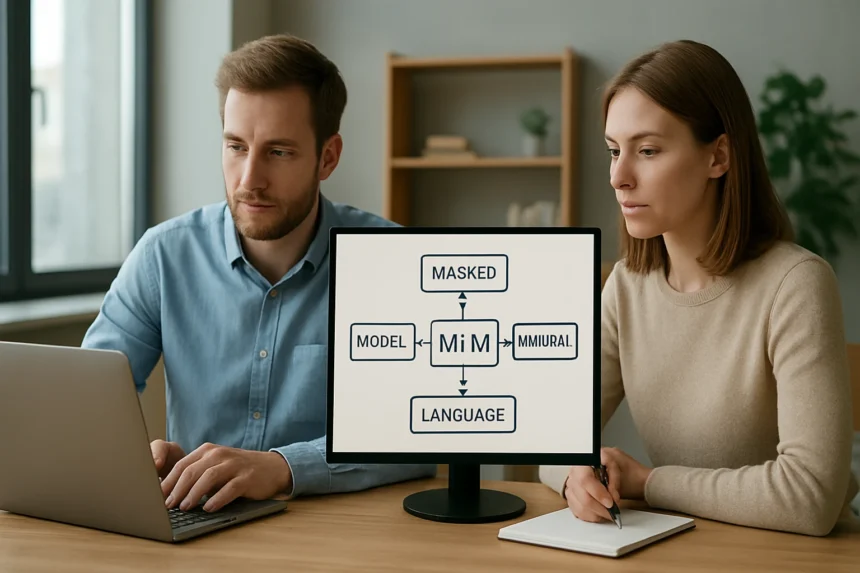

A maszkolt nyelvi modellek alapjai

A természetes nyelvfeldolgozás területén a maszkolt nyelvi modellek egy teljesen új paradigmát hoztak létre. Ezek a rendszerek azon az elven működnek, hogy a szövegből véletlenszerűen eltávolítanak bizonyos szavakat, majd megtanítják a modellt ezek helyreállítására.

A folyamat során a neurális hálózat nem lineárisan dolgozza fel a szöveget, hanem egyszerre vizsgálja az összes kontextust. Ez lehetővé teszi, hogy mélyebb nyelvi reprezentációkat alakítson ki, mint a korábbi megközelítések.

Az alapvető működési mechanizmus három fő komponensre épül:

- Tokenizálás: A szöveg kisebb egységekre bontása

- Maszkolás: Véletlenszerű szavak elrejtése a modell elől

- Predikció: Az elrejtett szavak megjóslása kontextus alapján

- Optimalizáció: A hibák alapján a modell finomhangolása

- Reprezentáció: Gazdag nyelvi jellemzők kialakítása

Transzformátor architektúra és figyelemmechanizmus

A maszkolt nyelvi modellek sikerének kulcsa a transzformátor architektúrában rejlik. Ez a felépítés forradalmasította a szekvenciális adatok feldolgozását azáltal, hogy megszüntette a hagyományos rekurrens feldolgozás korlátait.

A figyelemmechanizmus (attention mechanism) lehetővé teszi, hogy a modell egyidejűleg koncentráljon a szöveg különböző részeire. Minden szó kapcsolatba kerül minden más szóval, ami rendkívül gazdag kontextuális megértést eredményez.

| Komponens | Funkció | Előny |

|---|---|---|

| Multi-head Attention | Párhuzamos figyelemfókuszok | Többféle kapcsolat felismerése |

| Position Encoding | Pozíciós információ kódolása | Szórend megértése |

| Feed-forward Network | Nem-lineáris transzformáció | Komplex minták felismerése |

| Layer Normalization | Stabilizáció | Gyorsabb tanulás |

BERT: az első nagy áttörés

A BERT (Bidirectional Encoder Representations from Transformers) modell 2018-as megjelenése mérföldkő volt a természetes nyelvfeldolgozás történetében. Ez volt az első olyan rendszer, amely valóban kétirányú kontextust használt a nyelvi megértéshez.

A BERT innovatív megközelítése abban rejlett, hogy egyidejűleg vizsgálta a szavak előtti és utáni kontextust. Ez lehetővé tette olyan nyelvi árnyalatok megragadását, amelyek korábban elérhetetlenek voltak a gépi rendszerek számára.

"A kétirányú kontextus feldolgozása olyan mélységű nyelvi megértést tesz lehetővé, amely korábban elképzelhetetlen volt a gépi tanulás területén."

RoBERTa és az optimalizáció művészete

A RoBERTa (Robustly Optimized BERT Pretraining Approach) a BERT továbbfejlesztett változata, amely bebizonyította, hogy a helyes tréning stratégiák milyen jelentős teljesítményjavulást eredményezhetnek. A modell ugyanazt az architektúrát használja, mint a BERT, de optimalizált hiperparaméterekkel és tréning eljárásokkal.

A RoBERTa fejlesztői eltávolították a Next Sentence Prediction feladatot, és kizárólag a maszkolt nyelvi modellezésre koncentráltak. Ez a döntés jelentős teljesítményjavulást eredményezett számos downstream feladatban.

A tréning során nagyobb batch méreteket és hosszabb tréning időt alkalmaztak, ami lehetővé tette a modell számára, hogy mélyebb nyelvi mintázatokat sajátítson el.

ELECTRA: a hatékonyság új szintje

Az ELECTRA (Efficiently Learning an Encoder that Classifies Token Replacements Accurately) modell egy radikálisan eltérő megközelítést vezetett be. A hagyományos maszkolás helyett egy generátor-diszkriminátor párral dolgozik, ahol a generátor hamis tokeneket helyez el a szövegben, a diszkriminátor pedig felismeri ezeket.

Ez a megközelítés jelentősen hatékonyabbá teszi a tréning folyamatot, mivel minden pozícióból tanul a modell, nem csak a maszkolt tokenekből. Az eredmény egy olyan rendszer, amely kevesebb számítási erőforrással éri el a BERT-hez hasonló teljesítményt.

"A generátor-diszkriminátor architektúra új utakat nyit a hatékony nyelvi reprezentációk tanulásában."

Többnyelvű modellek és kulturális sokszínűség

A maszkolt nyelvi modellek egyik legnagyobb vívmása a többnyelvű feldolgozás területén mutatkozik meg. Az mBERT és XLM-R típusú modellek képesek egyidejűleg több mint 100 nyelvet kezelni, ami korábban elképzelhetetlen volt.

Ezek a rendszerek nemcsak fordítási feladatokban jeleskednek, hanem képesek nyelvek közötti tudástranszferre is. Egy angol nyelven tanult fogalom automatikusan elérhetővé válik más nyelveken is, ami különösen értékes a kevésbé erőforrásokkal rendelkező nyelvek esetében.

A többnyelvű modellek fejlesztése során különös figyelmet kell fordítani a kulturális torzítások kezelésére és a nyelvi sokszínűség megőrzésére.

Finomhangolás és domain-specifikus alkalmazások

A maszkolt nyelvi modellek valódi ereje a finomhangolás (fine-tuning) folyamatában mutatkozik meg. Ez a technika lehetővé teszi, hogy egy általános célú modellt specifikus feladatokra optimalizáljunk minimális további tréning adattal.

A finomhangolás során a modell meglévő nyelvi tudását alkalmazza új kontextusokban. Orvosi szövegek elemzésétől kezdve jogi dokumentumok feldolgozásáig, minden területen kiemelkedő eredményeket lehet elérni.

| Domain | Alkalmazási terület | Teljesítménynövekedés |

|---|---|---|

| Orvostudomány | Klinikai jegyzetek elemzése | 15-25% |

| Jog | Szerződések feldolgozása | 20-30% |

| Pénzügy | Kockázatelemzés | 12-18% |

| Tudományos kutatás | Publikációk kategorizálása | 18-28% |

Interpretálhatóság és magyarázhatóság

A maszkolt nyelvi modellek komplexitása komoly kihívásokat vet fel az interpretálhatóság területén. Annak megértése, hogy ezek a rendszerek hogyan hozzák meg döntéseiket, kritikus fontosságú a bizalomépítés és a felelős AI fejlesztés szempontjából.

Különböző technikák állnak rendelkezésre a modellek működésének vizsgálatára, mint például a figyelemvizualizáció, a gradiens-alapú módszerek és a perturbációs elemzések. Ezek az eszközök segítenek feltárni, hogy a modell mely nyelvi jellemzőkre támaszkodik döntései során.

"A nyelvi modellek interpretálhatósága nem luxus, hanem alapvető követelmény a felelős mesterséges intelligencia fejlesztésében."

Számítási hatékonyság és optimalizáció

A maszkolt nyelvi modellek egyik legnagyobb kihívása a számítási komplexitás kezelése. A nagy modellek óriási erőforrásigénye szükségessé teszi különféle optimalizációs technikák alkalmazását.

A desztilláció (distillation) folyamata során egy kisebb modellt tanítanak meg egy nagyobb modell viselkedésének utánzására. Ez jelentős teljesítménycsökkenés nélkül teszi lehetővé a modellek méretének csökkentését.

A kvantálás és a pruning technikák további lehetőségeket kínálnak a modellek hatékonyságának növelésére. Ezek a módszerek különösen fontosak mobil és edge computing alkalmazások esetében.

Etikai megfontolások és társadalmi hatások

A maszkolt nyelvi modellek széles körű elterjedése számos etikai kérdést vet fel. A tréning adatokban rejlő torzítások könnyen átörökíthetők a modellekbe, ami igazságtalan vagy diszkriminatív eredményekhez vezethet.

A nyelvi modellek társadalmi hatásainak vizsgálata során különös figyelmet kell fordítani a munkaerőpiacra gyakorolt befolyásra, az információs buborékok erősítésére és a dezinformáció terjesztésének lehetőségeire.

"A technológiai fejlődéssel együtt nő a felelősségünk is a társadalmi hatások gondos mérlegelésére."

Jövőbeli irányok és kutatási területek

A maszkolt nyelvi modellek területén folyamatosan új kutatási irányok nyílnak meg. A multimodális megközelítések, amelyek szöveget, képeket és hangot egyidejűleg dolgoznak fel, különösen ígéretesek.

A few-shot és zero-shot tanulás képességeinek további fejlesztése lehetővé teheti, hogy a modellek minimális példa alapján új feladatokat sajátítsanak el. Ez forradalmasíthatja a gépi tanulás alkalmazási területeit.

A neurális architektúrák keresése (Neural Architecture Search) automatizálhatja az optimális modellstruktúrák felfedezését, ami újabb teljesítményugrásokat eredményezhet.

Gyakorlati implementáció és deployment

A maszkolt nyelvi modellek gyakorlati alkalmazása során számos technikai kihívással kell szembenézni. A modell mérete, a válaszidő követelményei és a rendelkezésre álló infrastruktúra mind befolyásolják a deployment stratégiát.

A cloud-alapú megoldások rugalmasságot biztosítanak a skálázásban, míg az on-premise deployment nagyobb kontrollt tesz lehetővé az adatok felett. A hibrid megközelítések gyakran a legjobb kompromisszumot jelentik.

"A sikeres implementáció kulcsa a technikai követelmények és üzleti célok gondos egyensúlyozásában rejlik."

Benchmarkok és értékelési módszerek

A maszkolt nyelvi modellek teljesítményének objektív mérése összetett feladat, amely számos különböző metrika alkalmazását igényli. A GLUE és SuperGLUE benchmarkok széles körű értékelési kereteket biztosítanak.

Az intrinsic és extrinsic értékelési módszerek különböző szempontokból világítanak rá a modellek képességeire. Míg az intrinsic mérések a modell belső reprezentációit vizsgálják, az extrinsic értékelések konkrét feladatokban mért teljesítményt elemzik.

A human evaluation egyre fontosabbá válik, különösen a kreatív és szubjektív feladatok esetében, ahol a hagyományos automatikus metrikák nem adnak megfelelő képet.

Adatvédelem és biztonság

A maszkolt nyelvi modellek fejlesztése és alkalmazása során kiemelt figyelmet kell fordítani az adatvédelmi és biztonsági szempontokra. A modellek tréning adatai gyakran tartalmaznak érzékeny információkat, amelyek védelme kritikus fontosságú.

A differential privacy technikák alkalmazása segíthet minimalizálni az egyéni adatok kiszivárgásának kockázatát. A federated learning megközelítések lehetővé teszik a modellek tréningét anélkül, hogy a nyers adatok elhagynák eredeti helyüket.

"Az adatvédelem nem akadálya az innovációnak, hanem annak alapvető feltétele a fenntartható fejlődéshez."

Ipari alkalmazások és üzleti értékteremtés

A maszkolt nyelvi modellek ipari alkalmazásai rendkívül széles spektrumot ölelnek fel. A customer service automatizálásától kezdve a tartalom generálásig, ezek a technológiák jelentős üzleti értéket teremtenek.

A dokumentum-feldolgozás területén különösen nagy a potenciál. A szerződések automatikus elemzése, a compliance ellenőrzés és a kockázatértékelés mind olyan területek, ahol ezek a modellek kimagasló teljesítményt nyújtanak.

A kreatív iparágakban is egyre nagyobb szerepet kapnak ezek a technológiák. A tartalom-generálás, fordítás és lokalizáció területein új lehetőségeket nyitnak meg.

Mit jelent a "maszkolt" kifejezés a nyelvi modellekben?

A "maszkolt" arra utal, hogy a tréning során véletlenszerűen elrejtjük bizonyos szavakat a szövegből, és a modellt megtanítjuk ezek megjóslására a kontextus alapján.

Miben különbözik a BERT a korábbi nyelvi modellektől?

A BERT kétirányú kontextust használ, vagyis egyidejűleg vizsgálja a szavak előtti és utáni környezetet, míg a korábbi modellek csak egy irányban dolgozták fel a szöveget.

Milyen előnyei vannak a transzformátor architektúrának?

A transzformátor párhuzamos feldolgozást tesz lehetővé, gyorsabb tréninget eredményez, és a figyelemmechanizmus révén képes hosszú távú függőségeket is megragadni.

Hogyan működik a finomhangolás folyamata?

A finomhangolás során egy előre betanított modellt további tréningnek vetünk alá specifikus feladatra, kihasználva a meglévő nyelvi tudást és minimális új adattal optimalizálva a teljesítményt.

Milyen kihívások merülnek fel a többnyelvű modellekkel?

A főbb kihívások közé tartozik a nyelvi torzítások kezelése, a kulturális különbségek figyelembevétele, és az egyenlőtlen nyelvi reprezentáció problémája a tréning adatokban.

Hogyan lehet csökkenteni a modellek számítási igényét?

Különféle technikák alkalmazhatók: desztilláció kisebb modellek létrehozására, kvantálás a pontosság csökkentésére, pruning a felesleges kapcsolatok eltávolítására, és hatékony architektúrák tervezése.