A modern digitális világban minden másodpercben milliók kapcsolódnak weboldalakhoz és alkalmazásokhoz világszerte. Amikor egy népszerű szolgáltatás hirtelen túlterhelődik, az felhasználói elégedetlenséget és bevételkiesést okozhat. Ez a kihívás vezette el a fejlesztőket és rendszermérnököket ahhoz a megoldáshoz, amely ma már minden nagyobb online szolgáltatás gerincét alkotja.

A terheléselosztás egy olyan informatikai technika, amely a bejövő hálózati forgalmat és számítási feladatokat több szerver vagy erőforrás között osztja el optimálisan. Ez biztosítja, hogy egyetlen szerver se legyen túlterhelve, miközben a többi tétlenül várakozik. A témát sokféle szemszögből közelíthetjük meg: a hálózati infrastruktúra, a szoftverarchitektúra, a felhőalapú szolgáltatások vagy akár a teljesítményoptimalizálás oldaláról.

Az alábbi útmutató során részletesen megismerheted a terheléselosztás működési elveit, típusait és gyakorlati alkalmazásait. Megtudhatod, hogyan választható ki a megfelelő algoritmus különböző helyzetekben, milyen technológiák állnak rendelkezésre, és hogyan implementálható ez a megoldás a gyakorlatban. Emellett betekintést nyerhetsz a legújabb trendekbe és a jövő lehetőségeibe is ezen a területen.

Mi a terheléselosztás és miért kritikus fontosságú?

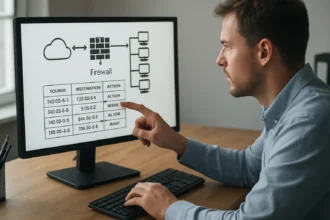

A terheléselosztás alapvetően egy intelligens forgalomirányítási rendszer, amely automatikusan eldönti, hogy a beérkező kéréseket melyik szerverhez irányítsa. Ez a döntés számos tényező alapján történik: a szerverek aktuális terheltsége, válaszideje, földrajzi elhelyezkedése vagy akár a felhasználó típusa szerint.

A technológia fontossága abban rejlik, hogy megoldja a skálázhatóság problémáját. Egyetlen szerver fizikai korlátai miatt csak meghatározott számú egyidejű felhasználót tud kiszolgálni. A terheléselosztás lehetővé teszi, hogy horizontálisan bővítsük a kapacitást új szerverek hozzáadásával.

Modern alkalmazásokban a terheléselosztás nem csupán a teljesítmény optimalizálásáról szól. Magas rendelkezésre állást biztosít azzal, hogy ha egy szerver meghibásodik, a forgalom automatikusan átirányítódik a működő példányokra.

A terheléselosztás alapvető típusai és kategóriái

Hálózati réteg szerinti osztályozás

Layer 4 (Transport Layer) terheléselosztás az OSI modell negyedik rétegében működik. Ez a típus a TCP és UDP protokollok szintjén dolgozik, és elsősorban az IP címek és portok alapján hozza meg döntéseit. Gyors és hatékony, mivel nem kell megvizsgálnia a HTTP tartalom részleteit.

Layer 7 (Application Layer) terheléselosztás sokkal intelligensebb megközelítést alkalmaz. Ez a típus képes elemezni a HTTP fejléceket, cookie-kat, URL-eket, sőt akár a kérés tartalmát is. Lehetővé teszi a fejlett útválasztási szabályok alkalmazását, például különböző API végpontok eltérő szerverekre irányítását.

Földrajzi elhelyezkedés alapján

A globális terheléselosztás (Global Server Load Balancing – GSLB) több adatközpont között osztja el a forgalmat. Ez különösen fontos nemzetközi szolgáltatások esetében, ahol a felhasználók földrajzi közelségben lévő szerverhez való irányítása jelentősen javítja a válaszidőt.

Helyi terheléselosztás egyetlen adatközponton belül működik, és a rendelkezésre álló szerverek között optimalizálja a forgalmat. Ez a leggyakoribb implementáció kisebb és közepes méretű alkalmazások esetében.

Terheléselosztási algoritmusok részletesen

| Algoritmus neve | Működési elv | Előnyök | Hátrányok |

|---|---|---|---|

| Round Robin | Ciklikus sorrendben osztja el a kéréseket | Egyszerű, справедливо | Nem veszi figyelembe a szerver kapacitást |

| Weighted Round Robin | Súlyozott ciklikus elosztás | Rugalmas, testreszabható | Statikus súlyozás |

| Least Connections | Legkevesebb kapcsolattal rendelkező szerver | Dinamikus terheléselosztás | Overhead a kapcsolatok nyomon követésében |

| IP Hash | Kliens IP alapján konzisztens irányítás | Session affinity | Egyenlőtlen eloszlás lehetősége |

Round Robin algoritmus

A Round Robin a legegyszerűbb és legszélesebb körben használt algoritmus. Minden bejövő kérést sorrendben a következő elérhető szerverre irányít, majd visszatér az első szerverhez. Ez biztosítja, hogy minden szerver egyenlő számú kérést kapjon hosszú távon.

Az algoritmus különösen hatékony olyan környezetekben, ahol a szerverek hasonló kapacitással rendelkeznek. Azonban nem veszi figyelembe a szerverek aktuális terhelését vagy a kérések komplexitását.

Súlyozott algoritmusok

A Weighted Round Robin lehetővé teszi, hogy különböző súlyokat rendeljünk a szerverekhez. Egy nagyobb kapacitású szerver magasabb súlyt kaphat, így több kérést fog kezelni. Ez rugalmasabb megoldást nyújt heterogén környezetekben.

A Weighted Least Connections algoritmus kombinálja a súlyozást a dinamikus terhelésmonitorozással. Nemcsak a szerverek kapacitását veszi figyelembe, hanem az aktuális kapcsolatok számát is, így még pontosabb terheléselosztást eredményez.

Intelligens algoritmusok

A Least Response Time algoritmus a leggyorsabban válaszoló szervert választja ki. Ez különösen hasznos olyan alkalmazások esetében, ahol a válaszidő kritikus fontosságú, mint például a valós idejű kereskedési rendszerek.

Az Adaptive algoritmusok gépi tanulást alkalmaznak a szerverek teljesítményének előrejelzésére. Ezek a rendszerek képesek tanulni a forgalmi mintákból és proaktívan optimalizálni a terheléselosztást.

"A hatékony terheléselosztás nem csupán a forgalom egyenletes elosztásáról szól, hanem arról, hogy minden felhasználó a lehető legjobb élményt kapja."

Hardveres és szoftveres megoldások összehasonlítása

Hardveres terheléselosztók

A dedikált hardveres eszközök kifejezetten terheléselosztásra tervezett fizikai berendezések. Olyan gyártók, mint az F5 Networks, Citrix NetScaler vagy a Kemp Technologies kínálnak ilyen megoldásokat. Ezek az eszközök rendkívül nagy teljesítményre képesek és speciális funkciókat tartalmaznak.

A hardveres megoldások előnyei közé tartozik a magas teljesítmény, a dedikált feldolgozási kapacitás és a gyártó támogatása. Azonban jelentős beruházást igényelnek és kevésbé rugalmasak a változó követelményekhez való alkalmazkodásban.

Szoftveres alternatívák

HAProxy az egyik legnépszerűbb nyílt forráskódú terheléselosztó. Rendkívül gyors, megbízható és széles körű konfigurációs lehetőségeket kínál. Különösen erős a Layer 7 terheléselosztásban és támogatja a fejlett egészségügyi ellenőrzéseket.

NGINX eredetileg webszerverként indult, de ma már az egyik vezető terheléselosztó megoldás. A NGINX Plus kereskedelmi változat további funkciókat kínál, mint például a dinamikus konfigurációt és a fejlett monitorozást.

Apache HTTP Server mod_proxy modulja szintén képes terheléselosztásra. Bár nem annyira specializált, mint a HAProxy, de sok esetben elegendő alapvető igények kielégítésére.

Felhőalapú terheléselosztási szolgáltatások

Amazon Web Services (AWS)

Az Application Load Balancer (ALB) az AWS Layer 7 megoldása, amely támogatja a HTTP/2 és WebSocket protokollokat. Képes útvonal-alapú útválasztásra és integrálódik az AWS ökoszisztéma többi szolgáltatásával.

A Network Load Balancer (NLB) Layer 4 szintű terheléselosztást biztosít ultramagas teljesítménnyel. Képes kezelni milliónyi kérést másodpercenként rendkívül alacsony késleltetéssel.

Microsoft Azure

Az Azure Load Balancer alapvető Layer 4 terheléselosztást nyújt Azure virtuális gépek között. Támogatja mind a belső, mind a külső forgalom kezelését.

Az Application Gateway Azure-specifikus Layer 7 megoldás, amely tartalmaz Web Application Firewall (WAF) funkciókat is. Ez különösen hasznos a biztonsági követelmények szigorú alkalmazások esetében.

Google Cloud Platform (GCP)

A Google Cloud Load Balancing globális terheléselosztást kínál, amely képes a forgalmat a világ különböző régióiban lévő példányok között elosztani. Az anycast IP címek használatával biztosítja, hogy a felhasználók mindig a legközelebbi végponthoz kapcsolódjanak.

Monitoring és teljesítménymérés

Kulcsfontosságú metrikák

A válaszidő (Response Time) az egyik legfontosabb mutató, amely meghatározza a felhasználói élmény minőségét. A terheléselosztónak folyamatosan monitoroznia kell ezt az értéket és szükség esetén módosítania kell az útválasztási döntéseket.

Az áteresztőképesség (Throughput) mutatja, hogy a rendszer hány kérést képes kezelni időegység alatt. Ez különösen fontos nagy forgalmú alkalmazások esetében, ahol a kapacitástervezés kritikus.

A hibaarány (Error Rate) jelzi a sikertelen kérések százalékos arányát. A terheléselosztónak képesnek kell lennie az egészségtelen szerverek automatikus kizárására a forgalomból.

Egészségügyi ellenőrzések

Aktív health check-ek során a terheléselosztó rendszeresen küld tesztkéréseket a szervereknek. Ha egy szerver nem válaszol megfelelően, automatikusan kiveszi a forgalomból, amíg újra egészséges állapotba nem kerül.

Passzív monitoring a valós forgalom alapján értékeli a szerverek állapotát. Ha egy szerver túl sok hibát produkál vagy lassú válaszidőket mutat, fokozatosan csökkenti a hozzá irányított forgalmat.

| Egészségügyi ellenőrzés típusa | Gyakoriság | Előnyök | Alkalmazási terület |

|---|---|---|---|

| HTTP GET | 5-30 másodperc | Egyszerű, gyors | Webalkalmazások |

| TCP Connect | 1-10 másodperc | Alacsony overhead | Adatbázis szerverek |

| Custom Script | 30-300 másodperc | Rugalmas, specifikus | Komplex alkalmazások |

| SSL Certificate | Óránként | Biztonsági megfelelőség | HTTPS szolgáltatások |

"A proaktív monitoring nemcsak a problémák korai felismerését teszi lehetővé, hanem megelőzi a szolgáltatáskiesések kialakulását is."

Session Affinity és Sticky Sessions

A probléma megértése

Sok webalkalmazás állapotfüggő (stateful), ami azt jelenti, hogy a felhasználói munkamenet adatait a szerver memóriájában tárolja. Ha a terheléselosztó minden kérést más szerverre irányít, a felhasználó elveszítheti a bejelentkezési állapotát vagy a bevásárlókosár tartalmát.

Session Affinity vagy Sticky Sessions biztosítja, hogy egy felhasználó minden kérése ugyanahhoz a szerverhez érkezzen a munkamenet során. Ez megoldja az állapotfüggőség problémáját, de korlátozza a terheléselosztás hatékonyságát.

Implementációs módszerek

Cookie-alapú affinity esetében a terheléselosztó egy speciális cookie-t helyez el a felhasználó böngészőjében, amely azonosítja a hozzárendelt szervert. Ez a módszer átlátszó a felhasználó számára és nem igényel alkalmazás-szintű módosításokat.

IP-alapú affinity a kliens IP címe alapján rendeli hozzá a szervert. Bár egyszerű megoldás, problémás lehet NAT-ot használó hálózatokban, ahol több felhasználó ugyanazzal az IP címmel jelenik meg.

Alternatív megközelítések

Session külső tárolása lehetővé teszi az állapotfüggő adatok központi tárolását Redis vagy Memcached segítségével. Ez megszünteti a sticky sessions szükségességét és javítja a skálázhatóságot.

Stateless alkalmazás tervezés a legelegánsabb megoldás, ahol az alkalmazás nem tárol állapotot a szerveren. Minden szükséges információ a kérésben vagy külső adatbázisban található.

SSL/TLS terminálás és biztonság

SSL Offloading

SSL/TLS terminálás azt jelenti, hogy a terheléselosztó kezeli a titkosított kapcsolatokat és visszafejti a forgalmat, mielőtt továbbítaná a backend szerverekhez. Ez jelentősen csökkenti a szerverek CPU terhelését, mivel a titkosítási műveletek számításigényesek.

A SSL offloading előnyei közé tartozik a jobb teljesítmény, központi tanúsítványkezelés és egyszerűbb konfiguráció. Azonban biztonsági megfontolásokat is felvet, mivel a belső hálózatban a forgalom titkosítatlan.

End-to-End titkosítás

SSL bridging vagy SSL pass-through esetében a titkosítás végig fennmarad a kliens és a backend szerver között. A terheléselosztó nem fejti vissza a forgalmat, így magasabb biztonsági szintet nyújt.

Ez a megközelítés különösen fontos olyan alkalmazások esetében, ahol szigorú megfelelőségi követelmények vannak, mint például az egészségügyi vagy pénzügyi szektorban.

Tanúsítványkezelés

Automatikus tanúsítvány megújítás kritikus fontosságú a folyamatos szolgáltatás biztosításához. A Let's Encrypt és hasonló szolgáltatások integrációja lehetővé teszi az ingyenes SSL tanúsítványok automatikus kezelését.

Wildcard tanúsítványok használata egyszerűsíti a több altartomány kezelését. Egyetlen tanúsítvány képes lefedni az összes aldomain-t, csökkentve a kezelési komplexitást.

"A biztonság és teljesítmény közötti egyensúly megtalálása kulcsfontosságú a modern terheléselosztási architektúrákban."

Hibakezelés és failover mechanizmusok

Automatikus failover

Aktív-passzív konfiguráció esetében egy elsődleges terheléselosztó kezeli a teljes forgalmat, míg egy másodlagos készenlétben várakozik. Ha az elsődleges meghibásodik, a másodlagos automatikusan átveszi a szerepét.

Aktív-aktív beállítás mindkét terheléselosztó egyidejűleg dolgozik, megosztva a forgalmat. Ez jobb erőforrás-kihasználást eredményez, de bonyolultabb szinkronizációt igényel.

Graceful degradation

Szolgáltatás szint csökkentés lehetővé teszi, hogy a rendszer részleges működőképességet fenntartson akkor is, amikor egyes komponensek meghibásodnak. Például egy e-kereskedelmi oldal továbbra is megjeleníthet termékeket, még ha a fizetési rendszer átmenetileg nem elérhető.

Circuit breaker pattern automatikusan megszakítja a hibás szolgáltatások felé irányuló kéréseket, megakadályozva a kaszkád hibák kialakulását. Ez védelem nyújt a teljes rendszer összeomlása ellen.

Disaster recovery

Georedundancia biztosítja, hogy a szolgáltatás több földrajzi helyszínen is elérhető legyen. Ha egy teljes adatközpont elérhetetlenné válik, a forgalom automatikusan átirányítható egy másik régióba.

Backup stratégiák nemcsak az adatok mentését foglalják magukban, hanem a konfigurációk és állapotinformációk rendszeres mentését is. Ez lehetővé teszi a gyors helyreállítást katasztrófa esetén.

Mikroszolgáltatások és konténerizáció

Service Mesh architektúra

Istio és Linkerd olyan service mesh megoldások, amelyek speciálisan mikroszolgáltatás környezetekhez tervezték a terheléselosztást. Ezek a rendszerek sidecar proxy-kat használnak minden szolgáltatás mellett, biztosítva a fejlett forgalomkezelést.

A service mesh előnyei közé tartozik a szolgáltatások közötti kommunikáció automatikus titkosítása, részletes telemetria gyűjtése és a forgalmi szabályok központi kezelése.

Kubernetes Load Balancing

Kubernetes Services különböző típusú terheléselosztást biztosítanak a pod-ok között. A ClusterIP belső forgalmat kezel, míg a LoadBalancer típus külső hozzáférést tesz lehetővé.

Ingress Controllers Layer 7 terheléselosztást nyújtanak Kubernetes környezetben. Népszerű megoldások közé tartozik az NGINX Ingress, Traefik és az AWS Load Balancer Controller.

Container orchestration

Docker Swarm beépített terheléselosztási képességekkel rendelkezik, amely automatikusan elosztja a forgalmat a szolgáltatás példányai között. Ez különösen hasznos kisebb deployment-ek esetében.

Consul Connect HashiCorp megoldása, amely service discovery-t és automatikus terheléselosztást kombinál. Képes dinamikusan felfedezni a szolgáltatásokat és intelligens forgalomirányítást biztosítani.

"A mikroszolgáltatások világában a terheléselosztás nemcsak teljesítményről szól, hanem a szolgáltatások közötti kommunikáció megbízhatóságáról is."

Teljesítményoptimalizálás és finomhangolás

Caching stratégiák

Content Delivery Network (CDN) integráció jelentősen javíthatja a globális teljesítményt. A terheléselosztó intelligensen irányíthatja a statikus tartalom kéréseit a CDN-hez, míg a dinamikus tartalom kéréseit a backend szerverekhez.

Application-level caching lehetővé teszi gyakran használt adatok memóriában való tárolását. A terheléselosztó figyelembe veheti a cache állapotát az útválasztási döntések során, optimalizálva a cache találati arányt.

Kompresszió és optimalizálás

HTTP/2 és HTTP/3 támogatás modern protokollok használatával javítja a teljesítményt. A terheléselosztó képes lehet protokoll konverzióra, lehetővé téve a régebbi backend szerverek számára az új protokollok előnyeinek kihasználását.

Gzip és Brotli kompresszió csökkenti a hálózati forgalmat és javítja a válaszidőt. A terheléselosztó szinten alkalmazott kompresszió tehermentesíti a backend szervereket.

Adaptív skálázás

Horizontal Pod Autoscaler (HPA) Kubernetes környezetben automatikusan növeli vagy csökkenti a pod-ok számát a terhelés alapján. Ez biztosítja, hogy mindig megfelelő kapacitás álljon rendelkezésre.

Predictive scaling gépi tanulási algoritmusokat használ a jövőbeli terhelés előrejelzésére. Ez lehetővé teszi a proaktív skálázást, elkerülve a hirtelen terhelésnövekedés okozta problémákat.

Jövőbeli trendek és fejlődési irányok

Mesterséges intelligencia integráció

AI-alapú terheléselosztás képes tanulni a forgalmi mintákból és automatikusan optimalizálni az útválasztási algoritmusokat. Ez különösen hasznos komplex, változó terhelésű környezetekben.

Anomália detektálás gépi tanulás segítségével azonosítja a szokatlan forgalmi mintákat, amelyek biztonsági fenyegetésre vagy rendszerhiba előjelére utalhatnak.

Edge computing

Edge load balancing a hálózat peremén végzett terheléselosztás, amely csökkenti a késleltetést és javítja a felhasználói élményt. Ez különösen fontos az IoT alkalmazások és valós idejű szolgáltatások esetében.

5G hálózatok új lehetőségeket nyitnak a mobil edge computing terén, ahol a terheléselosztás közvetlenül a mobilhálózat infrastruktúrájában történik.

Serverless architektúrák

Function-as-a-Service (FaaS) platformok új kihívásokat jelentenek a terheléselosztás terén. A függvények rövid életciklusa és automatikus skálázása megköveteli az adaptív terheléselosztási stratégiákat.

Event-driven architecture esetében a terheléselosztás nem csak a HTTP kérésekre vonatkozik, hanem esemény alapú kommunikációra is, ami új algoritmusok és megközelítések fejlesztését teszi szükségessé.

"A jövő terheléselosztási megoldásai intelligensek, adaptívak és képesek lesznek előre jelezni és megelőzni a problémákat, mielőtt azok befolyásolnák a felhasználói élményt."

Gyakorlati implementációs útmutató

Követelmények felmérése

A terheléselosztás tervezése során először alapos igényfelmérést kell végezni. Meg kell határozni a várt forgalmi volument, a csúcsidőszakokat és a kritikus teljesítménymutatókat. Ez alapján választható ki a megfelelő architektúra és technológia.

Költség-haszon elemzés segít eldönteni, hogy hardveres vagy szoftveres megoldást válasszunk, illetve hogy saját infrastruktúrát építsünk vagy felhőszolgáltatást használjunk.

Fokozatos bevezetés

Blue-green deployment stratégia lehetővé teszi a terheléselosztás biztonságos bevezetését. Az új konfiguráció párhuzamosan fut a régivel, és fokozatosan irányítjuk át a forgalmat.

Canary releases során a forgalom kis százalékát irányítjuk az új konfigurációhoz, lehetővé téve a fokozatos tesztelést és validálást éles környezetben.

Monitoring és optimalizálás

Teljesítmény baseline meghatározása elengedhetetlen a javulás méréshez. Rögzíteni kell a kiindulási teljesítménymutatókat, mielőtt bevezetjük a terheléselosztást.

Kontinuus optimalizálás során rendszeresen felül kell vizsgálni és finomhangolni a konfigurációt a változó követelményekhez és forgalmi mintákhoz igazodva.

"A sikeres terheléselosztás implementáció nem egy egyszeri projekt, hanem folyamatos fejlesztési és optimalizálási folyamat."

Milyen típusú alkalmazások profitálnak leginkább a terheléselosztásból?

A legnagyobb hasznot a nagy forgalmú webalkalmazások, e-kereskedelmi platformok, API szolgáltatások és valós idejű alkalmazások húzzák. Különösen fontos olyan rendszerek esetében, ahol a rendelkezésre állás kritikus, mint a pénzügyi szolgáltatások vagy egészségügyi rendszerek.

Hogyan választható ki a megfelelő terheléselosztási algoritmus?

Az algoritmus választása függ a szerverek kapacitásától, a kérések típusától és a session követelményektől. Egyforma szerverek esetében a Round Robin megfelelő, míg eltérő kapacitások mellett súlyozott algoritmusokat érdemes használni. Session-függő alkalmazásoknál sticky sessions vagy külső session tárolás szükséges.

Mekkora költségekkel kell számolni terheléselosztás bevezetésekor?

A költségek széles skálán mozognak. Nyílt forráskódú megoldások (HAProxy, NGINX) gyakorlatilag ingyenesek, csak a szerver költségeket kell fedezni. Hardveres megoldások több tízezer dollárba kerülhetnek, míg a felhő alapú szolgáltatások használat alapú díjazással működnek, általában havi néhány száz dollártól kezdődően.

Milyen biztonsági kockázatokat rejt a terheléselosztás?

A fő kockázatok közé tartozik az SSL terminálás miatti belső forgalom titkosítatlanság, a single point of failure lehetősége, és a DDoS támadások koncentrálódása. Ezek kezelhetők megfelelő architektúrával, redundanciával és biztonsági intézkedésekkel.

Hogyan mérhető a terheléselosztás hatékonysága?

A kulcs mutatók között szerepel a válaszidő javulása, az áteresztőképesség növekedése, a szerver CPU és memória kihasználtság egyenletessége, valamint a hibaarány csökkenése. Fontos még a felhasználói élmény mérése és a szolgáltatás rendelkezésre állásának monitorozása.

Lehet-e terheléselosztást használni kis forgalmú alkalmazások esetében?

Igen, még kis forgalmú alkalmazások is profitálhatnak a magas rendelkezésre állás és a jövőbeli skálázhatóság miatt. A költségek minimalizálása érdekében egyszerűbb, szoftveres megoldások vagy felhő alapú szolgáltatások ajánlottak.